G検定 実践模試 2026

〜本番突破のための究極の145問〜

当サイトの運営者が、最新のシラバスと傾向を徹底分析して作成。本番で差をつけるための実践問題集です。

-

✓

本番レベルの145問

最新傾向を反映した難易度設定 -

✓

法律・倫理分野を強化

具体例を通して理解 -

✓

80ページ超の圧倒的解説

「なぜそうなるか」を深く理解し、弱点を克服

試験内容解説

JDLA G検定の最新シラバスに沿って、全ワードを解説しています。(内容は随時アップデート中!!)

学習途中の理解確認や、試験前の総復習にぜひ活用してください。

シラバス内の全用語を1ページ内でまとめていますので使いやすいと思います!

【技術分野】

【法律・倫理分野】

用語検索

すべての用語を表示中

1. 人工知能の定義

AI効果

AI効果とは、かつては人工知能と呼ばれていた技術が普及・一般化するとAIと見なされなくなる現象を指す。音声認識や文字認識などが代表例であり、AIの定義は時代とともに変化するという点がG検定で頻出である。

エージェント

エージェントとは、環境を観測し、行動を選択して環境に働きかける主体のことを指す。人工知能分野では、知覚・意思決定・行動の一連の流れを持つ存在として定義され、強化学習の基本概念として扱われる。

人工知能

人工知能とは、人間の知的行動をコンピュータ上で実現しようとする技術・研究分野の総称である。明確な単一定義は存在しない点や、推論・学習・認識・判断などの機能を含む点が試験で問われやすい。

機械学習

機械学習とは、明示的なルールを与えず、データから規則性やパターンを学習する手法である。人工知能を実現する中核技術であり、教師あり学習・教師なし学習・強化学習に分類される点は頻出である。

ディープラーニング

ディープラーニングは、多層構造を持つニューラルネットワークを用いた機械学習手法である。特徴量を人手で設計せず、データから自動的に抽出できる点が特徴で、画像認識や音声認識で高い性能を示す。機械学習の一分野である点はG検定で非常に重要である。

2. 人工知能分野で議論される問題

シンギュラリティ

シンギュラリティとは、人工知能が人間の知能を超え、自己改良を繰り返すことで技術進歩が加速する転換点を指す概念である。実現時期や可能性については諸説あり、科学的に未確定な仮説である点が重要である。

シンボルグラウンディング問題

シンボルグラウンディング問題とは、記号(シンボル)が現実世界の意味とどのように結び付くかという問題である。単なる記号操作だけでは意味理解に至らない点が、人工知能の限界として議論される。

※人間は「シマウマ」を初めて見ても「白黒の縞模様の馬」という特徴から理解できるが、AIは「シマ」「ウマ」という記号を知っていても、実物を見ないと「シマウマ」を認識・理解できない。

身体性

身体性とは、知能は身体を通じた環境との相互作用によって形成されるという考え方である。人間の知能を理解・再現するには、身体や感覚を持つことが重要だとされる。

ダートマス会議

ダートマス会議は、1956年に人工知能という研究分野が初めて提唱された学術会議である。ここで初めて、“Artificial Intelligence (人工知能)”という言葉がジョン・マッカーシーによって使われ、人工知能研究が本格的に始まった点が試験で頻出である。

トイ・プロブレム

トイ・プロブレムとは、現実世界を大幅に単純化した問題設定を指す。研究初期には有効だったが、実問題への適用が難しい点が課題とされた。

※ハノイの塔、Nクイーン問題、スライドパズルなど

知識獲得のボトルネック

知識獲得のボトルネックとは、専門家の知識を人手でルール化・記述することの困難さを指す。特にエキスパートシステムで問題となり、機械学習台頭の背景となった。

チューリングテスト

チューリングテストとは、人間と機械を区別できなければ知能があるとみなす評価方法である。内部構造ではなく、外部から観測される振る舞いのみを基準とする点が特徴である。

中国語の部屋

中国語の部屋は、記号の操作ができても、その意味を理解しているとは限らないことを示す思考実験である。中国語を理解できない人が、分厚いマニュアルに従って記号を処理すれば、外部からは正しく中国語を理解しているように見える。これは、チューリングテストを通過しても「意味理解」や「意識」があるとは言えないという点で、強いAIの立場を批判している。

強いと弱いAI

強いAIとは、人間と同等の知能や意識を持つ人工知能を指す概念である。一方、弱いAIは特定の課題に特化した実用的な人工知能であり、有用な道具であれば良いという概念を意味する。現在のAIはすべて弱いAIに分類される。

統計的機械翻訳

統計的機械翻訳とは、大量の対訳コーパスから確率モデルを用いて翻訳を行う手法である。ルールを人手で作成しない点が特徴で、ニューラル機械翻訳以前の主流技術であった。

フレーム問題

フレーム問題とは、行動によって変化しない事柄を、いちいち明示せずに推論することの難しさを指す問題である。例えば「部屋の電気を消す」という行動をした際、机の位置や壁の色は変わらないが、それらすべてを毎回『変わらない』と記述するのは非現実的である。現実世界のような複雑な環境を扱う際に、知識表現と推論が爆発的に増える点が人工知能の根本的課題とされる。

ルールベース機械翻訳

ルールベース機械翻訳とは、文法規則や辞書を人手で定義して翻訳を行う手法である。高品質な翻訳が可能な一方、ルール作成のコストが高い点が課題である。

※1970年代後半はルールベース機械翻訳が一般的だったが、1990年代以降は統計的機械翻訳が主流となった点が重要である。

ローブナーコンテスト

ローブナーコンテストは、チューリングテストを基に人工知能を評価する競技会である。最も人間らしい対話を行ったプログラムが評価される点が特徴である。「チューリングテスト」の実践的な応用として位置づけられている。

※質問者は2台のディスプレイに質問を行う。1台は人間が操作して回答し、もう1台はコンピュータが人間を真似て回答する。質問と回答のやり取りを繰り返し、もし人間とコンピュータの見分けがつかなければ、コンピュータには知性があると判断する。

3. 探索・推論

αβ法

αβ法は、Mini-Max法を効率化するために、結果に影響しない枝を事前にカットする枝刈り手法である。αカットは自分(Max側)にとってこれ以上良くならない枝を省き、βカットは相手(Min側)が選ばないと分かった枝を省く。対戦ゲームの探索空間を削減できる点が重要で、Mini-Max法とセットで問われやすい。

Mini-Max 法

Mini-Max法は、相手が常に最善手を選ぶと仮定し、自分の最悪の損失を最小化する戦略である。将棋やオセロなどの対戦ゲームで用いられ、完全情報ゲームを前提とする点が重要である。

SHRDLU

SHRDLUは、自然言語で与えられた指示を理解し、積み木の世界を操作する初期のAIシステムである。限定された世界では高性能だが、現実世界へ拡張できない点が課題とされた。

STRIPS

STRIPSは、前提条件・行動・結果の3要素で問題を定義し、行動計画(プランニング)を行う記号的AI手法である。各行動は、実行可能かどうかを示す前提条件と、実行後に状態がどのように変化するかという結果を持つ。これらを組み合わせて目標状態に至る行動系列を探索するが、知識を人手で記述する必要がある点が課題とされる。

探索木

探索木とは、問題の状態遷移をノードと枝で表現した構造である。探索アルゴリズムは、この探索木をどの順序でたどるかの違いとして整理できる。

ハノイの塔

ハノイの塔は、再帰的思考や探索問題を説明するための代表的なパズルである。アルゴリズムの考え方を理解する例題として用いられることが多い。

※3本の杭とサイズの異なる複数の円盤を用いた数学的パズルのこと。「小さな円盤の上に大きな円盤を乗せない」という制限下で、全ての円盤を別の杭へ最小手数で移動させるゲーム

幅優先探索

幅優先探索は、探索木を浅い階層から順に探索する手法である。最短経路を必ず見つけられる一方、メモリ消費が大きい点が特徴である。

深さ優先探索

深さ優先探索は、一つの枝を可能な限り深く探索し、行き止まりで戻る手法である。メモリ効率は良いが、最短経路を保証しない点が重要である。

ブルートフォース

ブルートフォースとは、全ての可能性を列挙して解を探す力任せの探索手法である。理論的には確実だが、探索空間が大きい場合は非現実的となる。

モンテカルロ法

モンテカルロ法は、乱数による多数のシミュレーション結果から解を推定する手法である。探索空間が膨大な問題に有効で、囲碁AIなどで活用された点がG検定で押さえどころである。

4. 知識表現とエキスパートシステム

Cyc プロジェクト

Cycプロジェクトは、人間が持つ一般常識を形式知としてデータベース化する長期研究プロジェクトである。常識を明示的に記述する必要があり、30年以上たった今でも続いていることから、知識獲得のボトルネックの代表例としてG検定で扱われる。

DENDRAL

DENDRALは、専門家の知識をルールとして組み込んだ初期のエキスパートシステムである。有機化合物の分子構造推定に成功し、エキスパートシステムの有効性を示した点が重要である。

is-a の関係 / has-a の関係 / part-of の関係

これらは、概念間の関係を体系的に表現するための基本的な知識表現である。is-aは「AはBの一種(継承)」、has-aは「AはBを持つ(所有)」、part-ofは「AはBの一部(構成)」を表し、意味ネットワークやオントロジーの基礎となる。

QuestionAnswering

Question Answeringは、自然言語で与えられた質問に対し、適切な回答を生成・抽出することを目的とした研究分野である。情報検索や自然言語処理と密接に関連し、質問の形式や意図を解析することが重要な課題として扱われる。

意味ネットワーク

意味ネットワークは、概念をノード、関係を矢印などで表現する知識表現手法であり、もともとは認知心理学における長期記憶の構造モデルとして考案された。is-a関係などを用いて、人間の知識構造を直感的に表現できる点が特徴である。

イライザ (ELIZA)

ELIZAは、定型的なルールに基づいて人間との対話を模倣する初期の対話システムである。意味理解は行っておらず、表層的な会話でも知的に見える点が示された。

インタビューシステム

インタビューシステムは、専門家から知識を引き出し、形式知として整理するための支援システムである。エキスパートシステム構築において、知識獲得の効率化を目的とする。

ウェブマイニング

ウェブマイニングは、Web上の膨大なデータから有用な知識を抽出する技術である。コンテンツ・構造・利用履歴の分析に分けられる点も覚えておきましょう。

オントロジー

オントロジーとは、概念や関係を明示的に定義した知識の体系である。知識の共有や再利用を可能にする共通基盤として、意味ネットワークやセマンティックWebで重要な役割を果たす。

※知識を記述するときに用いる「語彙」や「その意味」、「それらの関係性」を他の人とも共有できるように明確な約束事として定義しましょうという意味。

セマンティック Web

セマンティックWebとは、Web上の情報に意味(メタデータ)を付与し、コンピュータが内容を理解・処理できるようにする構想である。人間向けの文章中心のWebに対し、機械が意味的に情報を結び付けられる点が特徴で、オントロジーを用いて知識を体系化する。

データマイニング

データマイニングとは、大量のデータから統計や機械学習を用いて有用なパターンを発見する技術である。知識表現とは異なり、データ駆動型である点が重要である。

東ロボくん

東ロボくんは、大学入試問題を解くことで人工知能の到達点と限界を検証した研究プロジェクトである。質問の意味を理解しているわけではないので読解力に問題があり、意味理解の難しさが明確になった点が重要である。

マイシン (MYCIN)

MYCINは、感染症の診断と治療方針の提案を行う医療分野のエキスパートシステムである。推論結果の不確実性を扱うため、確信度(確信係数)を用いてルールの信頼性を数値化した点が特徴で、完全に白黒つけられない医療判断への対応を可能にした。

ワトソン

ワトソンは、自然言語処理と大規模データ解析を組み合わせた質問応答システムである。アメリカのクイズ番組「ジョパディー!」で人間に勝利したことで、実用的AIの象徴的事例として扱われる。QuestionAnsweringの研究分野における、地道な努力の結晶ですが、利用している基本技術は従来のものと変わらない。

5. 機械学習

次元の呪い

次元の呪いとは、特徴量(次元)が増えるほど、必要なデータ量が指数的に増加する現象である。その結果、学習が困難になり、汎化性能が低下しやすい点が機械学習における重要な課題として扱われる。

スパムフィルタ

スパムフィルタは、機械学習によってメールをスパムか否かに分類する代表的な応用例である。特徴語の出現頻度などを用い、ナイーブベイズやロジスティック回帰などの分類アルゴリズムが用いられることが多い。

ビッグデータ

ビッグデータとは、量(Volume)・多様性(Variety)・速度(Velocity)を特徴とする大規模データを指す。機械学習や深層学習の性能向上を支える基盤として重要である。

レコメンデーションエンジン

レコメンデーションエンジンは、ユーザーの行動履歴や評価データから嗜好を予測する仕組みである。代表的手法として、協調フィルタリング(ユーザー間・アイテム間の類似度に基づく手法)が知られている。

統計的自然言語処理

統計的自然言語処理は、大量のテキストデータから単語の出現頻度や共起関係を統計的に学習し、意味や用法を推定する手法である。

※「bank」は銀行・川岸など複数の意味を持つが、近くに「money」や「in」などの語が現れる場合は「銀行」の意味で使われる確率が高いと判断する。

6. ディープラーニング

ImageNet

ImageNetは、1,400万枚以上の画像に人手でラベルを付与した大規模画像データセットである。ディープラーニングが高精度な画像認識を実現できた背景として、大量の教師付きデータの存在が不可欠であった点がG検定では重要である。

ILSVRC

ILSVRCは、ImageNetを用いて画像分類精度を競う国際コンテストであり、2012年にディープラーニング(AlexNet)が従来手法を大きく上回ったことが分野の転換点となった。ディープラーニングが実用レベルに達した象徴的出来事として頻出である。

※2012年の優勝者:ジェフリー・ヒントン(Geoffrey Hinton)教授率いるトロント大学のチーム「SuperVision」

LeNet

LeNetは、ヤン・ルカンらによって提案された畳み込みニューラルネットワークで、ネオコグニトロンのS細胞層・C細胞層の考え方を受け継いだ構造を持つ。畳み込み層はS細胞層、プーリング層はC細胞層に対応し、理論モデルを実用的な学習可能モデルとして完成させた点が重要である。

アルファ碁 (AlphaGo)

アルファ碁は、DeepMindが開発した囲碁AIで、ディープラーニングと強化学習、モンテカルロ木探索を組み合わせた点が特徴である。「人間を超えたAI」の象徴的事例として歴史的意義が強調される。

人間の神経回路

人間の神経回路は、ニューロン同士が信号を伝達する構造を持ち、ニューラルネットワークの着想源となった。ただし、生物学的な脳を忠実に再現しているわけではない点が重要である。

ネオコグニトロン

ネオコグニトロンは福島邦彦氏が提唱した神経回路モデルで、S細胞層(特徴抽出)とC細胞層(位置ずれへの不変性)からなる階層構造を持つ。現在のCNNの概念的原型だが、誤差逆伝播による学習は行わず、LeNetで初めて学習可能な形として実装された点が対比として重要である。

生成 AI

生成AIは、学習データの分布をもとに、文章・画像・音声などの新しいデータを生成するAIの総称である。識別(分類)ではなく生成を行う点が従来の機械学習との大きな違いである。

7. 教師あり学習

アンサンブル学習

アンサンブル学習は、複数の弱学習器を組み合わせて、より性能の高いモデルを構築する手法である。個々のモデルの誤りを補い合うことで、汎化性能が向上しやすい点が重要で、G検定では考え方そのものが頻出である。

※代表例として、決定木を多数組み合わせたランダムフォレストが挙げられる。

カーネル

カーネルは、高次元空間での内積を、元の低次元空間で効率的に計算するための関数である。これにより、非線形なデータ構造を線形分離問題として扱える点が重要である。

※多項式カーネルやガウスカーネル(RBFカーネル)が代表的である。

カーネルトリック

カーネルトリックは、実際に高次元空間へ写像することなく非線形分離を実現する技術である。計算量の増大を防ぎつつ複雑な境界を扱えるため、SVMの性能を支える中核的概念である。

※曲線状に分布したデータを直線で分離できるようにする場面で用いられる。

回帰問題

回帰問題は、連続した数値を予測する教師あり学習タスクである。出力が数値である点が分類問題との最も重要な違いであり、G検定では比較対象として頻繁に出題される。

※気温や売上高、株価などを予測する問題が代表例である。

決定木

決定木は、特徴量に基づく条件分岐を繰り返して分類や回帰を行う手法である。構造が直感的で理解しやすい一方、過学習を起こしやすい点が欠点として重要である。

※「年収が〇円以上か?」などの条件を順に判定して意思決定を行うモデルが例である。

勾配ブースティング

勾配ブースティングは、前のモデルの誤差を次のモデルが補正するように逐次学習を行う手法である。高精度なモデルを構築できる一方、計算コストが高くなりやすい点が注意点である。

※XGBoostやLightGBMは勾配ブースティングを基盤とした代表的手法である。

サポートベクターマシン (SVM)

SVMは、マージンを最大化する決定境界を求めることで高い汎化性能を実現する手法である。カーネル法と組み合わせて非線形問題に対応できる点がG検定の重要ポイントである。

※手書き文字認識やテキスト分類などで利用されてきた。

線形回帰

線形回帰は、入力と出力の関係を一次関数で表現する回帰手法である。モデルが単純で解釈しやすく、回帰分析の最も基本的な手法として位置づけられる。

※広告費から売上を予測するような単純な関係の分析に用いられる。

自己回帰モデル (ARモデル)

ARモデルは、過去の自分自身の値を説明変数として将来を予測する時系列モデルである。単一の時系列を扱う点がVARモデルとの重要な違いである。

※過去の売上データから翌月の売上を予測するようなケースで用いられる。

単回帰分析

単回帰分析は、1つの説明変数のみを用いて目的変数を予測する回帰手法である。重回帰分析との違い(説明変数の数)はG検定で定番の出題ポイントである。

※気温からアイスクリームの売上を予測するような単純な関係が例である。

重回帰分析

重回帰分析は、複数の説明変数を用いて1つの目的変数を予測する回帰手法である。年齢や身長、体重など複数要因が結果に影響する現実的な問題を扱える点が特徴で、単回帰分析との違い(説明変数の数)はG検定で頻出である。

※具体例として、不動産価格を「面積・築年数・駅からの距離」など複数の変数から予測するケースが挙げられる。

多クラス分類

多クラス分類は、3つ以上のカテゴリのいずれかに分類する教師あり学習タスクである。二値分類と異なり、クラス数の増加により問題が複雑になる点が特徴で、分類タスクの基本的な拡張形として理解が求められる。

※例えば、手書き数字を「0〜9」の10クラスに分類する問題は多クラス分類の代表例である。

バギング

バギングは、ブートストラップサンプリングによって作成した複数のデータ集合でモデルを並列学習するアンサンブル手法である。モデルのばらつきを抑え、分散を低減して過学習を防ぐ効果がある。

※決定木を多数並列に学習させ、それらの予測結果を多数決で統合する方法が典型例である。

※バギングは、アンサンブル学習を実現するための具体的なテクニックのひとつ。(アンサンブル学習→全体の考え方、バギング→具体的な手法 のようなイメージ)

ブースティング

ブースティングは、前のモデルが誤ったデータを次のモデルが重点的に学習する逐次型のアンサンブル手法である。弱学習器を積み重ねることで高精度を実現するが、過学習や計算コストに注意が必要である。

※AdaBoostや勾配ブースティングは代表的なブースティング手法として知られている。

ブートストラップサンプリング

ブートストラップサンプリングは、同じデータを重複して抽出することを許したランダムサンプリング手法である。限られたデータから複数の学習用データセットを作成できる点が重要である。

※この手法はバギングの前提となり、ランダムフォレストでも利用されている。

分類問題

分類問題は、入力データがどのカテゴリに属するかを予測する教師あり学習タスクである。出力がカテゴリである点が回帰問題との本質的な違いである。

※スパムメール判定や画像中の物体認識などが代表的な分類問題の例である。

ベクトル自己回帰モデル (VARモデル)

VARモデルは、複数の時系列変数が互いに影響を与え合う関係を同時に表現するモデルである。ARモデルが単一系列のみを扱うのに対し、多変量時系列を扱える点が重要である。

※経済学において、金利・物価・GDPの相互関係を分析する際によく用いられる。

マージン最大化

マージン最大化とは、決定境界と最も近いデータ点との距離を最大にする考え方である。この考え方により、未知データに対しても高い汎化性能が期待できる。

※SVMでは、このマージンを最大化する境界線を数学的に求める。

ランダムフォレスト

ランダムフォレストは、バギングと決定木を組み合わせたアンサンブル学習手法である。特徴量の一部をランダムに選択して分岐することで、決定木同士の相関を下げる工夫がなされている。

※分類・回帰の両方に対応でき、実務でも広く利用されている。

ロジスティック回帰

ロジスティック回帰は、入力からある事象が起こる確率を推定し、それに基づいて分類を行う手法である。名称に「回帰」とあるが、分類問題に用いられる点がG検定の定番出題ポイントである。

※例えば、ある顧客が商品を購入するか否かを確率として予測する場面で用いられる。

8. 教師なし学習

k-means 法

k-means法は、データをあらかじめ指定したk個のクラスタに分割する代表的なクラスタリング手法である。各データ点を最も近い重心に割り当て、重心を更新する操作を繰り返すことでクラスタを形成する。

クラスタ数kを事前に決める必要がある点や、初期値により結果が変わる点はG検定でよく問われる。

t-SNE

t-SNEは、高次元データの局所的な類似関係を保ったまま、2次元や3次元に可視化する手法である。非線形な構造を捉える能力が高く、可視化専用手法として位置づけられる。

次元削減後の軸には明確な意味がなく、解釈より可視化が目的である点が重要である。

※ 単語埋め込みや画像特徴量を2次元に可視化して分布を確認する際に用いられる。

ウォード法

ウォード法は、階層的クラスタリングにおいて、クラスタ内分散の増加が最小となるようにクラスタを結合する手法である。結果として、サイズのバランスが取れたクラスタが得られやすい。

距離の定義と結合基準の違いは、他の階層的手法との比較ポイントとなる。

協調フィルタリング

協調フィルタリングは、ユーザー同士、あるいはアイテム同士の類似性に基づいて推薦を行う手法である。個人の属性情報を明示的に使わず、行動履歴のみを利用する点が特徴である。

教師なし学習として扱われることが多く、レコメンデーション分野の中心技術である。

※ 映画配信サービスで「この映画を見た人はこれも見ています」と表示する仕組み。

クラスタリング

クラスタリングは、正解ラベルの存在しないデータを、類似度に基づいてグループ化する教師なし学習手法の総称である。k-meansや階層的クラスタリングなど、多様なアルゴリズムが含まれる。

分類問題との違い(ラベルの有無)はG検定で頻出である。

コールドスタート問題

コールドスタート問題とは、新規ユーザーや新規アイテムに関する履歴データが不足しているため、適切な推薦が困難になる問題である。

協調フィルタリングに特有の課題としてよく知られている。

コンテンツベースフィルタリング

コンテンツベースフィルタリングは、アイテムの属性情報とユーザーの過去の嗜好をもとに推薦を行う手法である。他ユーザーの情報に依存しないため、コールドスタート問題に比較的強い。

協調フィルタリングとの対比はG検定の定番テーマである。

※ 「過去にSF映画を多く視聴したユーザーにSF映画を推薦する」方式。

次元削減

次元削減は、情報の本質を保ったまま変数の数を減らす処理であり、計算量削減や可視化を目的として用いられる。

PCAやt-SNEなどが代表例であり、用途の違いを理解することが重要である。

主成分分析 (PCA)

PCAは、データの分散が最大となる直交方向(主成分)を見つけて次元を削減する線形手法である。統計的手法に基づいており、解釈性が比較的高い。

教師あり学習の前処理として使われる点も重要である。

※ 多数の相関した特徴量を少数の主成分にまとめる前処理。

潜在的ディリクレ配分法 (LDA)

潜在的ディリクレ配分法(LDA)は、 文書が複数のトピック(話題)の確率的な混合によって生成される と仮定する代表的な教師なし学習の確率モデルである。

各文書はトピックの確率分布、各トピックは単語の確率分布として表現され、 正解ラベルなしで文書集合の話題構造を推定できる。

※ ニュース記事から「政治」「経済」などの話題を自動抽出する。

デンドログラム (樹形図)

デンドログラムは、階層的クラスタリングの結合過程を木構造で表現した図である。どの水準でクラスタを切るかにより、クラスタ数を調整できる。

特異値分解 (SVD)

SVDは、行列を特異値と直交行列に分解し、重要な成分を抽出する数学的手法である。次元削減やノイズ除去の基礎技術として用いられる。

※ レコメンデーションにおけるユーザー×アイテム行列の分解。

トピックモデル

トピックモデルは、大量の文書集合から潜在的な話題構造を推定する教師なし学習モデルの総称である。LDAはその代表例である。

9. 強化学習

Actor-Critic

行動を決定する「Actor(方策)」と、その行動の良さを評価する「Critic(価値関数)」を 同時に学習させる強化学習アルゴリズム。 Actorは「どの行動を選ぶか」を学び、Criticは「その行動はどれくらい良かったか」を評価し、 その評価結果をActorにフィードバックする。 これにより、学習の安定性と収束速度が大幅に向上する。 例えばロボット制御では、Actorが動作を決め、Criticが転倒しにくさや移動効率を評価する。 G検定では方策勾配法+価値関数の融合モデルとしての理解が重要。

ε-greedy方策

通常は最も良いと推定される行動を選ぶ(活用)が、確率εでランダムな行動を選択する(探索)方策。 探索と活用のトレードオフを単純に実装できる。 例えばゲームAIにおいて、基本は勝率が最も高い手を打つが、5%の確率で別の手を試すことで、 より良い戦略を発見できる。 εを徐々に小さくすることで、初期は探索重視、後半は活用重視の学習が可能。 G検定では探索と活用のバランス制御の代表例として頻出。

REINFORCE

方策を直接パラメータ化し、得られた報酬を最大化するように勾配を計算して更新する 方策勾配法の基本アルゴリズム。 行動の確率分布を直接最適化するため、連続行動空間にも適用可能。 ただし分散が大きく、学習が不安定になりやすいため、ベースライン(状態価値関数など)を導入して 分散低減を行うことが多い。 G検定では「価値関数を使わず、方策を直接最適化」する点が問われる。

Q 学習

状態sで行動aを選んだときの価値を表す行動価値関数 Q(s,a) を学習し、 最適な行動方策を求める代表的な強化学習手法。 次状態で最大のQ値をとる行動を仮定して更新するため、 実際に選択した行動に依存しない「方策外学習(off-policy)」である。 ゲームAI、ロボット制御、推薦システムなど幅広く応用される。 G検定ではSARSAとの違い(on-policy / off-policy)が頻出。

UCB 方策(Upper Confidence Bound)

現在の平均報酬に加えて「不確実性(探索の必要性)」を考慮して行動を選択するバンディットアルゴリズム。 試行回数が少ない行動ほど探索価値が高く評価される。 G検定ではε-greedyとの比較が頻出。

※広告配信や推薦システムにおいて、未知の商品を適度に試しながら、 クリック率最大化を狙う場面で活用される。

行動価値関数

状態sで行動aを選択した場合に、将来的に得られる報酬の期待値を表す関数 Q(s,a)。 行動の良し悪しを数値化するため、強化学習の中心概念となる。 G検定では状態価値関数との違いが頻出。

状態価値関数

ある状態sにいること自体が、どれくらい将来の報酬につながるかを表す関数 V(s)。 行動選択に直接依存しないため、方策評価やActor-Critic法のCriticで利用される。 行動価値関数との違いを明確に区別できることが重要。

バンディットアルゴリズム

複数の選択肢から、限られた試行回数で報酬を最大化する問題設定。 各選択肢の報酬分布が未知であり、探索と活用のバランスが重要となる。 G検定ではMDPとの違い(状態遷移が存在しない)が狙われやすい。

※広告配信、A/Bテスト、推薦システムなどで実用化されている。

方策勾配法

行動の選択確率を直接最適化することで、最適な方策を学習する強化学習手法。

Q学習などの価値ベース手法では、まず行動価値関数 Q(s,a) を学習し、

そこから最適な行動を導くという間接的な方法をとるが、

方策勾配法では最適な方策そのものを直接学習する点が大きな特徴である。

これにより、「どの状態で、どの行動を、どの確率で選ぶべきか」を直接学習できる。

G検定では、「価値関数を介さず方策を直接最適化」という特徴と、

連続行動空間への適性が頻出ポイントとなる。

マルコフ決定過程(MDP)

状態、行動、報酬、遷移確率から構成される強化学習の数学的枠組み。 「次の状態は現在の状態と行動のみで決定される」というマルコフ性を仮定する。 ほぼすべての強化学習アルゴリズムの理論的基盤。

割引率

将来報酬を現在価値に換算する係数γ。 γが大きいほど将来を重視し、小さいほど短期利益を重視する。 ロボット制御や金融取引では設定次第で挙動が大きく変わる。

SARSA

現在の方策に従って実際に選択した行動に基づいてQ値を更新する 方策内学習(on-policy)アルゴリズム。 安定性は高いが、学習速度はQ学習より遅い傾向。 G検定ではQ学習との違いが最重要。

10. モデルの選択・評価

k-分割交差検証

データをk個に分割し、1つをテスト用、残りを学習用として学習・評価をk回繰り返す手法である。データが少ない場合でも評価の安定性を高められる点がG検定で重要である。

平均二乗誤差 (MSE)

平均二乗誤差は、予測値と実測値の差を二乗して平均した回帰評価指標である。大きな誤差を強く罰する性質を持つ。

二乗平均平方根誤差 (RMSE)

RMSEはMSEの平方根を取った指標で、誤差の単位が元データと一致する点が特徴である。回帰モデルの直感的な誤差把握に用いられる。

平均絶対値誤差 (MAE)

MAEは、予測誤差の絶対値を平均した回帰評価指標である。外れ値の影響を受けにくい点がMSEとの違いとして問われやすい。

ROC 曲線・AUC

ROC曲線は、偽陽性率と真陽性率の関係を表す分類性能曲線である。AUCはその下面積を表し、しきい値に依存しない性能評価指標として頻出である。

赤池情報量規準 (AIC)

AICは、モデルの当てはまりの良さと複雑さを同時に評価する指標である。値が小さいほど良いモデルとされ、過学習防止の考え方と結びつく。

\(L\) は尤度、\(k\) はモデルのパラメータ数を表し、複雑なモデルほどペナルティが大きくなる。

オッカムの剃刀

オッカムの剃刀とは、同等の性能ならより単純なモデルを選ぶべきという考え方である。モデル選択や過学習対策の思想的背景としてG検定で問われる。

過学習

過学習とは、訓練データに過度に適合し、未知データで性能が低下する現象である。汎化性能の低下とセットで理解することが重要である。

交差検証

交差検証は、データ分割を工夫してモデル性能を安定的に評価する手法の総称である。k分割交差検証はその代表例として頻出である。

偽陽性・偽陰性

偽陽性は実際は陰性なのに陽性と判定する誤り、偽陰性は実際は陽性なのに陰性と判定する誤りである。医療や異常検知の文脈で特に重要である。

真陽性・真陰性

真陽性は正しく陽性と判定したケース、真陰性は正しく陰性と判定したケースである。分類性能指標の基礎要素として必須である。

混同行列

混同行列は、分類結果を4つの要素で整理した表である。TP(真陽性)、FP(偽陽性)、TN(真陰性)、FN(偽陰性)から構成され、分類性能指標の基盤となる。

正解率・適合率・再現率・F 値

正解率は全体の正答割合、適合率は陽性と予測した中の正解率、再現率は本来陽性の検出率である。F値は適合率と再現率の調和平均である。

汎化性能

汎化性能とは、未知データに対しても高い性能を保つ能力を指す。過学習の有無を判断する中心概念として重要である。

ベイズ情報量規準 (BIC)

BICはAICと同様にモデルの適合度と複雑さを評価する指標である。データ数が多いほど複雑なモデルに厳しい点が特徴である。

\(L\) は尤度、\(k\) はパラメータ数、\(n\) はデータ数を表し、AICより強いペナルティを与える。

ホールドアウト検証

ホールドアウト検証は、データを学習用とテスト用に一度だけ分割する評価手法である。簡便だが評価のばらつきに注意が必要である。

11. ニューラルネットワークとディープラーニング

CPU

CPUは、汎用的な逐次処理を得意とするプロセッサである。制御処理や軽量な計算に向くが、大量の並列演算には不向きな点がG検定で押さえるポイントである。

GPU

GPUは、多数の演算を同時に処理できる並列計算向けプロセッサである。行列演算が中心のディープラーニングに適している点がCPUとの違いとして頻出である。

TPU

TPUは、Googleが開発したディープラーニング専用の演算チップである。TensorFlow向けに最適化され、高速かつ省電力である点が特徴である。

隠れ層・入力層・出力層

ニューラルネットワークは、入力層・隠れ層・出力層から構成される。隠れ層が特徴表現を学習する役割を担い、層を深くすることで表現力が高まる。

多層パーセプトロン

多層パーセプトロンは、隠れ層を1層以上持つ全結合型ニューラルネットワークである。非線形活性化関数の導入により非線形問題を扱える点が重要である。

単純パーセプトロン

単純パーセプトロンは、入力層と出力層のみからなる最も基本的なモデルである。線形分離可能な問題しか解けないという制約がG検定で頻出である。

12. 活性化関数

Leaky ReLU 関数

Leaky ReLUは、負の入力に対しても小さな傾きを持たせたReLUの改良版である。ReLUの「死んだニューロン問題」を緩和できる点が重要である。

ReLU 関数

ReLUは、負の値を0、正の値をそのまま出力する活性化関数である。計算が高速で勾配消失が起きにくいため、現在の深層学習で最も広く使われている。

tanh 関数

tanh関数は、出力を −1 から 1 の範囲に正規化する活性化関数である。シグモイド関数より勾配消失が起きにくいが、深い層では問題が残る。

シグモイド関数

シグモイド関数は、出力を 0 から 1 に収めるS字型の関数である。勾配消失が起きやすく、現在は中間層ではほとんど使われない。

ソフトマックス関数

ソフトマックス関数は、複数の出力を確率分布に変換し、合計を1にする関数である。多クラス分類の出力層で使用される点が試験で頻出である。

勾配消失問題

勾配消失問題とは、誤差逆伝播の過程で勾配が極端に小さくなり、学習が進まなくなる現象である。シグモイドやtanhで起きやすく、ReLU系で緩和される。

13. 誤差関数

Contrastive Loss

Contrastive Lossは、似ているデータ同士の距離を小さくし、異なるデータ同士の距離を大きくするように学習させる損失関数である。対照学習(コントラスト学習)や、顔認識などの表現学習で用いられる。

ここで、\( y \) はペアが異なるクラスかどうかを示すラベル(\( y = 1 \) の場合、ペアは異なるクラス、\( y = 0 \) の場合、ペアは同じクラス)、\( m \) はマージン、\( d \) はペアの距離です。

Triplet Loss

Triplet Lossは、「基準(Anchor)」「正例(Positive)」「負例(Negative)」の3点を用いて、正例を近づけ、負例を遠ざけるように学習する損失関数である。顔認識や類似検索で頻出である。

- \( d_p \) :AnchorとPositiveの距離(\( d_p = distance(f(x_a), f(x_p)) \))

- \( d_n \) :AnchorとNegativeの距離(\( d_n = distance(f(x_a), f(x_n)) \))

- \( g \) :ギャップパラメータ(マージン)

- \( f \) :CNNを表し、特徴量を抽出する関数

- \( x_a, x_p, x_n \) :Anchor、Positive、Negativeの各入力

カルバック・ライブラー情報量 (KL)

KLダイバージェンスは、2つの確率分布の「ずれ」を定量化する指標である。非対称であり距離ではない点が試験で狙われやすい。

\( P \):真の分布、\( Q \):近似分布。VAEなどで用いられる。

交差エントロピー

交差エントロピーは、分類問題において予測確率と正解ラベルの差を測る標準的な誤差関数である。ソフトマックス関数と組み合わせて使われる。

\( y \):正解ラベル、\( \hat{y} \):予測確率

平均二乗誤差関数 (MSE)

平均二乗誤差は、回帰問題で予測値と正解値の差の2乗の平均を最小化する誤差関数である。外れ値の影響を受けやすい点に注意する。

\( y \):正解値、\( \hat{y} \):予測値、\( N \):データ数

14. 正則化

L0 正則化

L0正則化は、0でないパラメータの個数にペナルティを課し、変数選択を直接行う正則化である。

\( \mathbf{w} \) はモデルの重みベクトル、 \( \| \mathbf{w} \|_0 \) は 0でない重みの個数を表す。

最適化が困難(組合せ最適化)なため、実用ではあまり使われない。

L1 正則化

L1正則化は、重みの絶対値の和をペナルティとする正則化である。一部の重みが完全に0になる性質を持つ。

\( w_i \) は各特徴量に対応する重み、 \( \lambda \) は 正則化の強さを制御するハイパーパラメータである。

特徴量選択の効果があり、ラッソ回帰で用いられる。

L2 正則化

L2正則化は、重みの2乗和をペナルティとする正則化である。重みを0にはしないが小さく抑える。

\( w_i \) はモデルの重み、 \( \lambda \) は ペナルティ項の影響度を調整する係数である。

学習を安定化させ、多重共線性に強い。リッジ回帰で用いられる。

正則化

正則化とは、モデルが訓練データに適合しすぎる(過学習)ことを防ぐため、損失関数にペナルティ項を追加する手法の総称である。

\( \lambda \) は正則化の強さを調整するハイパーパラメータ。

ドロップアウト

ドロップアウトは、学習時にランダムに一部のニューロンを無効化することで、特定の経路への依存を防ぐ正則化手法である。

推論時には全ニューロンを使用する点に注意。

ラッソ回帰

ラッソ回帰は、L1正則化を用いた回帰モデルである。不要な特徴量の係数を0にする効果がある。

リッジ回帰

リッジ回帰は、L2正則化を用いた回帰モデルである。係数を小さく保ち、学習の不安定さを抑える。

15. 誤差逆伝播法

勾配消失問題

勾配消失問題とは、誤差逆伝播の過程で勾配が層を遡るごとに極端に小さくなる現象である。その結果、入力層付近の重みがほとんど更新されず学習が進まなくなる。シグモイド関数やtanh関数との関連が頻出である。

勾配爆発問題

勾配爆発問題とは、逆伝播中に勾配が過度に大きくなり、重み更新が発散する現象である。学習が不安定になり損失がNaNになるなどの問題を引き起こし、勾配クリッピングなどで対処される。

信用割当問題

信用割当問題とは、最終的な出力や報酬に対して、どの層・どの重みがどれだけ寄与したかを特定するのが困難である、という問題である。誤差逆伝播法はこの問題を解決するための仕組みとして位置づけられる。

連鎖律

連鎖律とは、合成関数の微分を各関数の微分の積として表す微分法則である。誤差逆伝播法は連鎖律を用いて各層の勾配を計算する点が試験で重要である。

16. 最適化手法

※最適化手法の世代順を明確にするため、シラバスの記載順序とは変更した順番で掲載しております。

AdaGrad

パラメータごとに過去の勾配の大きさを蓄積し、頻繁に更新される特徴量の学習率を小さくする最適化手法。疎な特徴量を扱う問題に強いが、学習が進むと更新が止まりやすい。

AdaDelta

AdaGradで問題となる学習率の過度な減衰を防ぐため、過去の勾配の二乗和ではなく指数移動平均を利用する手法。初期学習率を明示的に設定しなくてよい点が特徴。

RMSprop

AdaGradの学習率低下問題を、勾配の二乗の指数移動平均を用いて解決する最適化手法。AdaDeltaが更新量そのものを制御するのに対し、RMSpropは学習率の調整に重点を置く点が違い。

Adam

モーメンタムとRMSpropを組み合わせた最適化手法で、現在最も広く使われている。勾配の一次モーメントと二次モーメントを推定し、安定かつ高速な学習を実現する。

AdaBound

Adamの高速な初期収束とSGDの安定した最終収束を両立させる最適化手法。学習率に上下限(Bound)を設け、学習後半でSGDに近い挙動になる点が特徴。

AMSBound

Adamが持つ収束性の欠陥を修正したAMSGradと、学習率を一定範囲に制限するAdaBoundの考え方を組み合わせた最適化手法。学習初期はAdamのように高速に学習し、終盤はSGDのような安定した収束と高い汎化性能を目指す。

鞍点

ある次元から見ると極小だが、別の次元から見ると極大となる点を指す。勾配がほぼゼロになるため、勾配降下法で学習が停滞する原因として重要。

イテレーション

ミニバッチ1回分のデータを用いて重みを1回更新する単位。1エポックあたりのイテレーション数は「データ数 ÷ バッチサイズ」で与えられる。

エポック

訓練データ全体を1回すべて学習に使用する単位。エポック = 全データを1周であり、イテレーションとバッチサイズと密接に関係する。

オンライン学習

データが逐次到着する状況で、その都度モデルを更新する学習方式。ストリーミングデータやリアルタイム処理に適している。

学習率

1回の更新でパラメータをどれだけ動かすかを決める重要なハイパーパラメータ。大きすぎると発散し、小さすぎると学習が遅くなる。

確率的勾配降下法 (SGD)

ランダムに選んだ1サンプルまたはミニバッチの勾配を用いて更新する手法。確率的な揺らぎにより局所最適解や鞍点から抜けやすい特徴を持つ。

グリッドサーチ

あらかじめ定めたハイパーパラメータの候補を格子状にすべて試し、最適な組み合わせを探索する手法。計算コストが高く、次元が増えると非効率になりやすい。

勾配降下法

損失関数の勾配の逆方向にパラメータを更新し、値を最小化する基本的な最適化手法。多くの学習アルゴリズムの基礎となっている。

局所最適解

全体で最小ではないが、近傍では最小となる解を指す。勾配降下法ではここに捕まり、学習が進まなくなることがある。

早期終了

検証データの誤差が悪化し始めた時点で学習を止めることで、過学習を防ぐ正則化手法の一種。深層学習で頻繁に用いられる。

大域最適解

損失関数全体の範囲で最も小さい値を取る真の最適解。局所最適解と対比して理解することが重要。

二重降下現象

モデルの複雑さを増すと、誤差が一度増加した後、さらに増やすと再び低下する現象。過学習の常識に反する挙動として注目されている。

ノーフリーランチの定理

すべての問題に対して常に最良となる万能なアルゴリズムは存在しないことを示す定理。問題設定に応じた手法選択の重要性を示している。

ハイパーパラメータ

学習率や層の数など、学習前に人間が設定するパラメータ。グリッドサーチやランダムサーチで調整される。

バッチ学習

全訓練データを用いて一度に勾配を計算し、重みを更新する学習方式。計算は安定するが、計算コストが高い。

ミニバッチ学習

データを小さなミニバッチに分け、バッチごとに更新を行う学習方式。計算効率と安定性のバランスが良い。

モーメンタム

過去の更新方向を慣性として考慮し、更新を加速させる手法。振動を抑え、鞍点や局所解から抜けやすくする。

ランダムサーチ

ハイパーパラメータ空間からランダムに値を選び試行する手法。高次元空間ではグリッドサーチより効率的とされる。

17. 全結合層

重み

各入力信号の重要度を表す学習可能なパラメータ。誤差逆伝播法によって更新され、モデルの性能を大きく左右する。

線形関数

入力の加重和として出力を計算する関数で、全結合層の基本構造を成す。線形変換のみでは表現力が不足するため、非線形活性化関数と組み合わせて用いられる。

18. 畳み込み層

Atrous Convolution

フィルタ要素の間に間隔を空けることで、解像度を維持したまま受容野を拡大する畳み込み手法。Dilated Convolutionと同義。

Depthwise Separable Convolution

チャンネル方向の畳み込み(Depthwise)と、チャンネル統合(Pointwise)を分離することで、計算量とパラメータ数を大幅に削減する手法。MobileNetなどで使用される。

Dilated Convolution

フィルタ内に間隔(dilation)を設け、パラメータ数を増やさずに広範囲の特徴を捉える畳み込み。Atrous Convolutionと同義。

カーネル

入力データに対して畳み込み演算を行う小さな重み行列。画像からエッジや模様などの特徴を抽出する役割を持つ。

ストライド

フィルタを移動させる画素間隔を表すパラメータ。値を大きくすると出力サイズは小さくなり、計算量が減少する。

畳み込み操作

フィルタを入力上でスライドさせ、積和演算により局所特徴を抽出する計算。CNNの基盤となる処理。

簡単な処理手順は必ず押さえましょう(計算問題対策)。

畳み込みニューラルネットワーク (CNN)

畳み込み層とプーリング層を組み合わせた深層学習モデル。局所特徴の階層的学習により、画像認識で高い性能を示す。

特徴マップ

畳み込み演算によって得られる出力データで、抽出された特徴の分布を表す。フィルタの数だけ生成される。

パディング

入力画像の周囲を0埋めなどで拡張し、出力サイズの縮小を防ぐ処理。特徴抽出位置の偏りを防ぐ効果もある。

フィルタ

カーネルと同義で、特定のパターンを検出するための重み行列。学習によって最適な値が自動調整される。

19. 正規化層

グループ正規化

チャンネルを複数グループに分割し、グループごとに正規化を行う手法。バッチサイズに依存しないため、ミニバッチが小さい場合に有効。

バッチ正規化

ミニバッチ単位で平均0・分散1に正規化し、学習の安定化と高速化を実現する手法。深層学習で最も広く用いられる正規化層。

レイヤー正規化

1サンプル内の全チャンネルを用いて正規化する手法。バッチサイズに依存しないため、RNNやTransformerなどでよく使用される。

インスタンス正規化

画像1枚・1チャンネルごとに正規化を行う手法。画風変換(スタイル変換)など、スタイルの正規化が重要なタスクで用いられる。

20. プーリング層

グローバルアベレージプーリング (GAP)

各特徴マップの空間方向の平均を取り、チャンネルごとに1値へ集約する手法。全結合層の代替としてパラメータ削減と過学習防止に有効で、CNNの分類層で頻出。

最大値プーリング

領域内の最大値のみを抽出するプーリング手法。位置ズレに強い不変性を獲得でき、CNNで最も一般的に用いられる。

不変性の獲得

対象物の位置や大きさが多少変化しても、同一の特徴として認識できる性質。プーリング層の主要な役割としてG検定で頻出。

平均値プーリング

領域内の平均値を出力し、特徴を滑らかに集約する手法。最大値プーリングとの違いが比較問題として頻出。

21. スキップ結合

ResNet

スキップ結合(残差接続)を導入し、勾配消失問題を緩和することで、100層を超える非常に深いネットワークの学習を可能にしたモデル。残差学習という考え方がG検定で頻出。

22. 回帰結合層

BPTT

時系列方向にネットワークを展開し、過去へ遡って誤差を伝播するRNN専用の誤差逆伝播法。勾配消失・爆発問題と強く関係し、G検定で頻出。

GRU

LSTMを簡略化した構造で、リセットゲートと更新ゲートを持つ。計算量が少なく高速で、LSTMとの比較がG検定で頻出。

LSTM

長期依存関係を学習可能にするため、入力・出力・忘却の3つのゲートとセル状態を持つRNN。勾配消失問題の解決策として超頻出。

エルマンネットワーク

隠れ層の出力を次時刻の入力へ戻す基本的なRNN構造。RNNの原型モデルとしてG検定で用語理解が問われる。

勾配消失問題

誤差逆伝播を繰り返す過程で勾配が極端に小さくなり、長期依存を学習できなくなる現象。LSTM・GRU誕生の背景として超重要。

勾配爆発問題

誤差逆伝播時に勾配が指数関数的に増大し、学習が不安定になる現象。勾配クリッピングなどで対策される。

教師強制

学習時に、前時刻の予測値ではなく正解ラベルを次入力として使用する手法。収束を高速化するが推論時との差に注意である。

ゲート機構

情報を通す・遮断する制御構造で、LSTM・GRUの核心技術。シグモイド関数により0〜1の値で通過量を制御し、長期記憶保持を可能にする。

双方向 RNN (Bidirectional RNN)

過去→未来と未来→過去の双方向から時系列を処理するRNNで、文脈理解の向上が目的である。計算コストが通常のRNNに比べて2倍になる点には注意が必要だが、優れた性能を発揮する場面が多い。

時系列データ

時間順序に意味を持つデータで、RNNの主要対象。

※音声・文章・株価などが代表例。

ジョルダンネットワーク

出力層の値を次時刻の隠れ層へ戻すRNN構造。エルマンネットワークとの違いが比較問題として出題される。

リカレントニューラルネットワーク (RNN)

内部に再帰構造(ループ)を持ち、時系列や文章を扱えるニューラルネットワークの総称。LSTM・GRUはRNNの発展形。

23. Attention

Attention

入力系列の中から、現在の出力にとって重要な部分に重みを付けて集約する仕組み。

固定長ベクトルに圧縮せず、必要な情報を必要なタイミングで動的に参照できるため、

長文処理・翻訳・要約などで高性能を実現する。

基本構造は、Query・Key・Value(Q, K, V) の3つのベクトルを用い、

類似度(QKᵀ) → 正規化(Softmax) → 重み付き和 により出力を計算する。

Self-Attention

入力系列自身の内部で単語同士の関係性を計算し、文脈を考慮した表現を生成する仕組み。

各単語は、系列内のすべての単語との関連度を評価するため、

長距離依存関係を効率的に学習可能。

RNNのような逐次処理が不要であり、並列計算が可能な点が大きな利点。

Multi-Head Attention

Self-Attentionを複数のヘッドで並列実行し、

異なる観点(構文・意味・位置関係など)から情報を捉える仕組み。

各ヘッドは異なる線形変換を通したQ, K, Vを使用し、

得られた出力を連結して最終出力を形成することで、

表現力を大幅に向上させる。

Seq2Seq

Encoderが入力系列を固定長ベクトルに変換し、

Decoderがそれを用いて出力系列を生成する

Encoder-Decoder構造のモデル。

機械翻訳・要約・音声認識などで利用される。

従来のSeq2Seqは固定長ベクトルへの圧縮による情報損失の問題を抱えており、

長文になるほど性能が低下しやすい。

Source-Target Attention

Seq2Seqモデルにおいて、 DecoderがEncoderの出力系列(Source)を参照して 出力系列(Target)を生成するためのAttention機構。 Cross-Attentionとも呼ばれ、 翻訳精度を大きく向上させた。

Transformer

RNNやCNNを一切用いず、Attention機構のみで構成されたモデル。

Self-AttentionとFeed Forward層を積み重ねた構造を持つ。

並列計算が可能で学習効率が非常に高く、

BERT・GPT・T5など現代の大規模言語モデルの基盤となっている。

位置エンコーディング

TransformerではRNNのような逐次処理を行わないため、

単語の順序情報を明示的に付与する必要がある。

サイン・コサイン関数などを用いて位置情報ベクトルを生成し、

単語埋め込みに加算することで語順情報を保持する。

クエリ(Query)

現在注目している単語が、 「何を探しているか」を表すベクトル。 Keyとの内積によって関連度を算出する。

キー(Key)

Queryと照合される検索対象のラベルの役割を持つベクトル。 類似度計算(QKᵀ)に利用される。

バリュー(Value)

Attention重みによって線形結合され、 最終的に取り出される情報本体を表すベクトル。

24. オートエンコーダ

VQ-VAE / info VAE / β-VAE

・VQ-VAE:潜在変数を離散値で表現する変分オートエンコーダで、コードブックを用いた量子化により高品質な画像生成を実現する。

・info VAE:潜在変数と入力データの相互情報量を最大化することで、情報量の豊富な潜在表現を学習するモデルである。

・β-VAE:損失関数のKLダイバージェンス項に係数βを掛け、潜在変数の独立性(disentanglement)を強く促進する手法である。

次元削減

オートエンコーダの中間層である潜在空間により、入力データを低次元へ圧縮し、本質的な特徴のみを抽出する手法である。主成分分析(PCA)と異なり、非線形変換を用いることで複雑な構造も表現できる点が重要である。

事前学習

事前学習とは、大規模データを用いてモデルをあらかじめ学習させ、その重みを別のタスクに転用する手法である。転移学習などに応用され、学習の高速化や少量データでの精度向上に有効である。

積層オートエンコーダ

複数のオートエンコーダを層状に重ね、段階的に特徴を抽出する深層モデルである。各層を事前学習し、その後に全体を微調整することで、高精度な表現学習が可能となる。

変分オートエンコーダ (VAE)

潜在変数が確率分布に従うように学習する生成モデルであり、新しいデータを生成できる点が特徴である。損失関数は再構成誤差とKLダイバージェンスから構成され、潜在空間の正則化を行う。これにより、連続的で滑らかな潜在空間が形成され、サンプリングによる生成が可能となる。

25. データ拡張

Contrast

画像のコントラスト(明暗差)をランダムに変化させ、照明条件の違いに対する汎化性能を高める手法である。明るさや影の影響を受けにくいモデルの学習に有効である。

Brightness

画像全体の明るさをランダムに変更し、撮影環境の違いを模擬するデータ拡張である。過学習を抑え、照度変化に強いモデルの構築に寄与する。

Crop

画像の一部を切り抜くことで、位置ずれやスケール変化への耐性を高める手法である。ランダムクロップは局所特徴の学習促進に有効である。

CutMix

2枚の画像を部分的に切り貼りし、ラベルもその面積比で線形混合する強力なデータ拡張手法である。正則化効果が高く、分類精度の向上が期待できる。

Cutout

画像の一部を矩形領域で0(黒)などに置換して隠す手法である。局所的な特徴への依存を防ぎ、ロバスト性を高める効果がある。Random Erasingと異なり、置換する値は固定である点が特徴である。

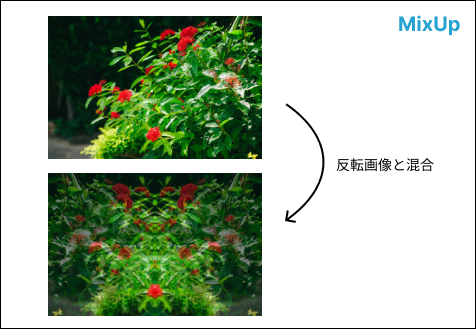

Mixup

2枚の画像とそのラベルを線形補間して合成するデータ拡張手法である。決定境界の平滑化により、過学習の抑制と汎化性能の向上を実現する。

noising

入力データにランダムなノイズを付加し、外乱に強いモデルを学習させる手法である。画像認識や音声認識において、ロバスト性の向上に有効である。

paraphrasing

文の意味を保ったまま言い換えを行う自然言語処理のデータ拡張手法である。表現の多様性を増やし、汎化性能を向上させる。

例:

・「今日は雨が降っている」→「今日は雨が降っています」

・「彼は速く走った」→「彼は素早く走った」

・「その映画は面白かった」→「その映画は楽しかった」

RandAugument

複数のデータ拡張手法をランダムかつ自動的に組み合わせて適用する手法である。ハイパーパラメータ調整の手間を削減しつつ、高い性能を実現できる。

Random Erasing

画像の一部をランダムな矩形領域で消去またはノイズ置換する手法である。Cutoutに比べ、消去する値をランダムに変化させることが多く、より多様な表現でロバスト性を向上させる。

Random Flip

画像を左右または上下にランダム反転させ、姿勢変化への耐性を高める基本的な拡張手法である。特に物体認識タスクで広く用いられる。

Rotate

画像をランダムな角度で回転させ、傾きに対する不変性を学習させる手法である。撮影角度のばらつきを補正し、汎化性能を向上させる。

26. 画像認識

AlexNet

2012年のILSVRCで圧勝し、深層学習ブームの火付け役となったCNNモデル。ReLU活性化関数やDropoutを採用し、学習の高速化と過学習抑制を実現した。

DeepLab

空洞畳み込み(Atrous Convolution)を用いて、解像度を維持しつつ精度の高いセマンティックセグメンテーションを行うモデルである。

DenseNet

各層の出力を後続すべての層の入力に接続する密集接続を採用。勾配消失を防ぎつつ、パラメータ効率を向上させた深層CNNモデルである。

EfficientNet

ネットワークの深さ・幅・解像度をバランスよくスケーリングすることで、計算効率と精度を両立させたモデルである。

Fast R-CNN

R-CNNを改良し、画像全体に一度だけCNNを適用することで速度を向上。RoIプーリングにより精度も確保した物体検出モデルである。

Faster R-CNN

Region Proposal Network(RPN)を導入し、候補領域の抽出もネットワーク内で自動化。高速かつ高精度な物体検出を実現した。

FCN (Fully Convolutional Network)

全結合層を排除し畳み込み層のみで構成。任意サイズの画像入力が可能で、ピクセル単位の分類を実現するセグメンテーションモデルである。

FPN

Feature Pyramid Network。異なる解像度の特徴マップを統合するピラミッド構造により、小さな物体の検出精度を向上させる。

GoogLeNet

Inceptionモジュールを導入し、横に広い構造で22層を実現。パラメータを抑えつつ高い表現力を持つCNNモデルであり、2014年のILSVRCで優勝した。

Mask R-CNN

Faster R-CNNを拡張し、物体検出に加えて各物体のマスク(形状)を推定するインスタンスセグメンテーションモデルである。

MnasNet

強化学習を用いたNeural Architecture Search(NAS)により、モバイル端末上での推論速度を最適化した自動設計モデルである。

MobileNet

Depthwise Separable Convolutionを採用し、計算量とモデルサイズを大幅に削減。モバイル端末向けの軽量CNNモデルである。

NAS (Neural Architecture Search)

ニューラルネットワークの構造設計を自動化する技術。強化学習などのアルゴリズムで最適なアーキテクチャを探索する。

Open Pose

画像から複数人物の関節位置をリアルタイムで検出し、骨格(ポーズ)を推定するライブラリである。

PSPNet

Pyramid Pooling Moduleを導入し、広域な文脈情報を考慮することで高精度なセマンティックセグメンテーションを実現するモデルである。

ResNet

残差学習(スキップ接続)を導入し、100層を超える深いネットワークの学習を可能にしたモデルである。勾配消失を抑え、非常に深いネットワーク構築が可能。

SegNet

デコーダ側でプーリング時の位置情報を再利用することで、物体境界を鮮明に再現するセグメンテーションモデルである。

SENet

Squeeze-and-Excitation(SE)ネットワーク。チャンネルごとの重要度を学習し、重要な特徴を強調するチャネル注意機構を持つCNNモデルである。2017年のILSVRCで優勝し、高精度画像認識モデルとして注目された。

SSD

Single Shot MultiBox Detector。1回の画像走査で、異なるサイズの候補領域を用いて高速に物体検出を行う手法である。

UNet

U字型構造を持ち、少量の学習データでも高精度なセグメンテーションを実現するモデル。医療画像解析で広く利用される。

VGG

3×3の小さなフィルタを積み重ね、多層化(16層や19層)した単純構造のCNN。汎用性の高さと学習安定性を示した。

Vision Transformer

画像をパッチに分割して入力し、自然言語処理のTransformer構造を直接応用。長距離依存関係を学習可能な最新の画像認識モデルである。

Wide ResNet

深さを増やす代わりに、各層のチャンネル数を増やして(太くして)学習効率と性能を向上させたCNNモデルである。

YOLO

You Only Look Once。画像を格子状に分割し、1回の推論で境界ボックスとクラスを同時に予測する超高速物体検出手法である。

一般物体認識

画像から特定の物体のカテゴリ・位置・形状などを判定する技術全般の総称。特定物体認識が1種類または少数の物体を識別するのに対し、一般物体認識は多数のカテゴリを対象に包括的に認識する点が異なる。

インスタンスセグメンテーション

個々の個体(例:人Aと人B)を区別し、ピクセル単位で切り出す物体識別とセグメンテーションを統合したタスクである。

姿勢推定

画像や動画から人間の関節位置や特徴点を検出し、身体の構えやポーズを推定する技術である。

セマンティックセグメンテーション

画像内の全ピクセルに「道路」「車」などのラベルを割り当てるが、個体の区別は行わない手法である。

物体検出

画像内のどこに何があるかを境界ボックスとラベルで特定するタスクである。代表的手法にはR-CNN系(Fast R-CNN, Faster R-CNN, Mask R-CNN)やYOLO、SSDなどがある。

物体識別

画像全体に写っている物体のカテゴリ判定を1つまたは複数行うタスクである。

パノプティックセグメンテーション

セマンティックとインスタンスを統合し、個体の区別と背景(空、森など)の分類を同時に行う統合型セグメンテーション手法である。

27. 自然言語処理

BERT

Transformerのエンコーダのみを用いた事前学習モデルで、文脈を双方向から同時に学習する点が最大の特徴である。事前学習ではMasked Language Model(MLM)とNext Sentence Prediction(NSP)を用い、文理解能力を高めている。分類、質問応答、文書検索など多くのタスクで高精度を達成し、NLP分野の性能を大きく押し上げた。

BoW (Bag-of-Words)

文章を単語の集合(袋)として扱い、出現順序を無視して単語頻度のみでベクトル化する特徴表現手法である。実装が容易で計算効率が高い一方、語順や文脈情報を失うため、意味理解には限界がある。TF-IDFなどと組み合わせて用いられることが多い。

CBOW

word2vecの代表的モデルの1つで、周囲の単語から中心単語を予測することで単語分散表現を学習する。学習が高速で安定しており、大規模コーパスから効率よく単語ベクトルを獲得できる。Skip-gramと対比して出題されやすい。

CEC

Constant Error Carouselは、LSTM内部に存在する記憶セル構造で、誤差を一定のまま伝播させる役割を持つ。これにより長期依存関係を学習可能となり、従来のRNNで問題となっていた勾配消失を大幅に緩和する。

ChatGPT

GPT系列モデルを基盤とし、RLHF(人間のフィードバックによる強化学習)によって対話向けに最適化された大規模言語モデルサービスである。安全性や有用性、自然な応答品質を高めるために、教師あり微調整と強化学習が段階的に行われている。

ELMo

双方向LSTMを用いた事前学習型単語表現モデルで、文脈に応じて単語ベクトルが動的に変化する。従来のword2vecやGloVeが文脈非依存であったのに対し、ELMoは文脈依存表現を実現し、下流タスクの精度向上に大きく貢献した。

fastText

単語を文字n-gramに分割して学習することで、未知語や綴り揺れに強い単語表現を獲得する手法である。学習と推論が非常に高速で、大規模テキスト分類や感情分析などで広く利用されている。

GLUE

自然言語理解モデルの性能を多角的に評価するための標準ベンチマークである。文分類、含意認識、文類似度評価など複数タスクから構成され、モデルの総合的言語理解能力を測定する目的で用いられる。

GPT-n

Transformerのデコーダのみを用いた自己回帰型の大規模言語モデル群である。次単語予測による事前学習により、文章生成、要約、翻訳、対話など幅広いタスクに対応可能で、大規模化による性能向上(スケーリング則)が特徴である。

n-gram

隣接する\(n\) 個の単語または文字を1単位として扱う言語モデルである。\(n=1\) はユニグラム、\(n=2\) はバイグラムと呼ばれ、確率的言語モデルや特徴抽出の基本手法として広く利用される。

PaLM

Googleが開発した大規模言語モデル(LLM)で、5400億パラメータを持つ超巨大Transformerモデル。Pathwaysと呼ばれる分散学習基盤を用いたスケーラブルな学習アプローチにより、単一モデルで多様なタスクを同時に学習できる点が特徴である。自己教師あり学習による大規模事前学習を行い、文脈理解、論理推論、算術推論、プログラミングコード生成などにおいて非常に高い性能を示した。少量の例を与えるだけでタスクを解決するfew-shot learning能力にも優れており、近年の大規模言語モデル研究の方向性を決定づけた代表的モデルの一つである。

Seq2Seq

Encoderが入力系列を固定長ベクトルに変換し、

Decoderがそれを用いて出力系列を生成する

Encoder-Decoder構造のモデル。

機械翻訳・要約・音声認識などで利用される。

従来のSeq2Seqは固定長ベクトルへの圧縮による情報損失の問題を抱えており、

長文になるほど性能が低下しやすい。

TF-IDF

単語の文書内頻度TFと、文書集合全体での希少性IDFを掛け合わせ、文書における単語の重要度を算出する指標である。検索エンジンや文書分類の前処理として広く利用される。

word2vec

単語を低次元の分散表現へ変換する手法で、CBOWとSkip-gramの2方式がある。意味的・文法的類似性をベクトル演算で表現でき、「王様−男性+女性=女王」の例が有名である。分散表現の基礎として頻出。

感情分析

テキストの内容から、ポジティブ・ネガティブ・ニュートラルなどの感情極性や、喜び・怒り・悲しみなどの感情カテゴリを推定する自然言語処理タスク。レビュー分析、SNS解析、顧客満足度調査などに広く利用される。従来はBoWやTF-IDFとSVMなどの機械学習が主流であったが、現在ではBERTなどの事前学習済み言語モデルを微調整(ファインチューニング)して高精度に分類する手法が主流である。

機械翻訳

ある言語の文章を、コンピュータを用いて別の言語へと自動的に変換する技術。初期はルールベース翻訳や統計的機械翻訳(SMT)が用いられていたが、現在はSeq2SeqモデルやTransformerに基づくニューラル機械翻訳(NMT)が主流となっている。大規模並列コーパスを用いた学習により、人間に近い自然な翻訳が可能となっている。

形態素解析

文を意味を持つ最小単位である形態素に分割し、品詞や活用形を付与する自然言語処理の基本処理。日本語では単語境界が明示されていないため、形態素解析が特に重要である。MeCabやSudachiなどの解析器が代表例であり、後続の構文解析・情報検索・感情分析など多くのタスクの前処理として用いられる。

構文解析

文中の単語間の主述関係や修飾関係を解析し、木構造(構文木)などで表現する処理。係り受け解析や依存構造解析が代表的であり、意味理解、質問応答、機械翻訳などの精度向上に寄与する。近年ではBERTなどの分散表現を用いたニューラルネットワークによる構文解析が主流となっている。

質問応答

与えられた質問文に対し、文書データベースや知識ベースから適切な答えを抽出または生成する自然言語処理タスク。BERTなどを用いたQAや、GPT系列などの大規模言語モデルによる生成型QAが実用化され、チャットボットや対話AIの中核技術となっている。

情報検索

大量の文書集合から、ユーザーの検索クエリに最も関連性の高い文書を抽出・順位付けする技術。TF-IDFやBM25などの古典的スコアリング手法に加え、BERTなどを用いた意味ベース検索(Dense Retrieval)が発展している。検索エンジンや社内文書検索システムの基盤技術である。

スキップグラム

word2vecの一種で、中心の単語からその周囲にある単語を予測するように学習するモデル。CBOWとは逆方向の学習を行う。低頻度語の学習に強く、意味的に類似した単語が近いベクトル空間に配置される特徴を持つ。単語の意味的関係を捉える分散表現の代表的手法である。

単語埋め込み

単語をコンピュータが扱いやすい実数値ベクトルに変換する手法。word2vec、GloVe、fastTextなどが代表例である。意味的・文脈的な類似性を幾何学的距離として表現できるため、分類・翻訳・要約など多くの自然言語処理タスクの基盤技術として用いられる。

分散表現

単語や文を、数百次元程度の密な実数ベクトルとして表現する手法。ワンホット表現と異なり、意味的類似性を距離として表現可能である。word2vecやBERTの埋め込み表現が代表例であり、深層学習による自然言語処理の性能向上を支える重要概念である。

文書要約

長文から重要な情報を抽出し、簡潔な文章としてまとめるタスク。重要文を選択する抽出型要約と、新しい文を生成する生成型要約に大別される。近年はTransformer系モデルを用いた生成型要約が主流であり、ニュース要約や議事録作成に応用されている。

ワンホットベクトル

語彙数と同じ次元を持ち、対象単語の位置のみ1、それ以外を0とする表現。単純で解釈しやすいが、高次元・疎・意味情報を持たないという欠点があり、現在は分散表現への置き換えが一般的である。

大規模言語モデル (LLM)

数十億〜数千億規模のパラメータを持つ巨大なニューラルネットワークを用いて学習された言語モデルの総称。GPT、PaLM、LLaMAなどが代表例。事前学習+ファインチューニングにより、翻訳・要約・質問応答・対話など幅広いタスクに高い汎用性を発揮する。

統計的機械翻訳

統計的機械翻訳とは、大量の対訳コーパスから確率モデルを用いて翻訳を行う手法である。ルールを人手で作成しない点が特徴で、ニューラル機械翻訳以前の主流技術であった。

28. 音声処理

A-D変換

アナログの音声信号を、サンプリング・量子化・符号化の3段階で デジタル信号へ変換する処理。サンプリングではナイキストの定理により、 元信号の2倍以上の周波数で標本化する必要がある。音声処理や信号処理の 基礎中の基礎技術であり、G検定頻出。

WaveNet

DeepMindが提案した深層生成モデルで、 音声の生波形を1サンプルずつ予測して生成する。 拡張畳み込み(Dilated Convolution)により長時間依存性を学習し、 極めて自然な音声合成を実現した。

音韻

言語として意味の違いを生む頭の中の音の区別ルール。 実際に発声される物理的な音である音素と異なり、 「同じ音として認識されるグループ」を表す。 例えば「か」と「が」は別の音韻だが、「か」の発音の微妙な違いは同一音韻として扱われる。

音声合成

テキストから人間の音声を生成するText-to-Speech(TTS)技術。 WaveNetやTacotronなどの深層学習モデルにより、 極めて自然な音声生成が可能となった。

音声認識

音声を解析してテキストへ変換するSpeech-to-Text(STT)技術。 従来はHMM、現在はDNN・RNN・Transformer を用いたEnd-to-Endモデルが主流である。

音素

実際に発声される物理的な最小音声単位(a、k など)。 抽象概念である音韻と対比され、 音声認識では基本的な分析単位となる。

隠れマルコフモデル(HMM)

古典的な音声認識モデルとして広く用いられてきた確率的時系列モデル。 音声を構成する音素の系列を時間方向にモデル化し、どの音素がどのタイミングで現れるかを確率的に予測する。 「隠れ」とは、観測される音声データ(音響特徴量)の背後にある、直接は見えない音素の状態遷移を推定する点を指す。 「意図や文脈」ではなく、音響的な最小単位の状態を確率的に扱うのがこのモデルの特徴である。

感情分析

音声から話者の感情状態(喜怒哀楽など)を推定する技術。 ピッチ、抑揚、スペクトル特徴量などを用いて分類する。

高速フーリエ変換 (FFT)

時間領域信号を周波数領域へ高速変換する信号処理の基本アルゴリズム。 音声解析・特徴抽出・スペクトル分析に不可欠である。

スペクトル包絡

スペクトル全体の形状を表し、 声質・母音識別に強く関係する特徴量。 MFCCなどで近似的に抽出される。

パルス符号変調 (PCM)

アナログ信号をデジタル信号へ変換する基本的なA-D変換方式。 主に以下の3手順から構成される。

- 標本化(サンプリング):一定時間間隔で信号値を取得する

- 量子化: 測定した音の大きさを、最も近い代表値に丸める処理。 例えば0〜100の連続値を、0・25・50・75・100の5段階に 当てはめるように、有限個のレベルに区切る。

- 符号化:量子化値をビット列(0と1)に変換する

フォルマント

音声スペクトル中の共振ピーク。 第1・第2フォルマントは母音識別に特に重要。

フォルマント周波数

各フォルマントの出現周波数で、 話者固有の音声特徴を反映する。

メル周波数ケプストラム係数 (MFCC)

音声認識で最も代表的な特徴量。 FFT → メルフィルタ → 対数 → DCT の流れで算出され、 聴覚特性を反映する。

メル尺度

人間の聴覚特性を反映した非線形周波数尺度。 MFCC算出の基盤となる。

話者識別

音声から話者の個人識別を行うタスク。 MFCCや深層学習モデルが利用される。

CTC (Connectionist Temporal Classification)

音声認識や手書き文字認識などにおいて、 入力系列と出力系列の長さが異なる問題を扱うための 損失関数および学習アルゴリズム。 フレーム単位の入力音声と、文字列出力のアライメント(対応付け)を明示的に与えず、 End-to-End学習を可能にした点が最大の特徴である。 空白ラベル(blank)を導入し、同一ラベルの連続出力を統合することで、 時間伸縮のある系列データを柔軟に扱える。

29. 深層強化学習

※この章は難しいので他章よりも少し詳しく説明していきます。

A3C

Asynchronous Advantage Actor-Critic の略。

複数のエージェント(学習主体)を並列・非同期に動かし、

それぞれが独立に環境を探索しながら得た経験を共有して学習する深層強化学習手法。

通常の強化学習では、1つのエージェントが順番に試行錯誤するため学習が遅くなりがちであるが、

A3Cでは複数エージェントが同時に探索を行うため、

多様な経験を高速に収集でき、学習の安定性と収束速度が大きく向上する。

Actor(行動選択)と Critic(評価)を併用する構造であり、

Advantage(平均との差)を用いることで学習の分散を抑える工夫もなされている。

G検定では「非同期・並列学習」と「Actor-Critic構造」が頻出ポイント。

Agent57

DeepMind が開発した深層強化学習エージェントで、

Atari 57種類すべてのゲームにおいて人間のプレイヤーを超える性能を初めて達成した。

最大の特徴は、探索(新しい行動を試す)と活用(得意な行動を使う)のバランス制御を

極めて高度に行える点である。

単純な ε-greedy ではなく、複数の探索戦略を同時に走らせ、それらを統合することで、

広範な探索と安定した学習を両立している。

G検定では「Atari全57種制覇」「探索戦略の高度化」という実績ベースの知識として問われやすい。

APE-X

Distributed Prioritized Experience Replay を中核とした分散型深層強化学習フレームワーク。

多数のエージェントが並列に環境と相互作用し、

それぞれが収集した経験データを中央サーバに蓄積する。

その際、学習に有用なデータを優先的に再生する「優先度付き経験再生」を用いることで、

学習効率を大幅に向上させている。

A3Cが「勾配の非同期更新」に重点を置くのに対し、

APE-Xは大量データの高速収集+再利用に重点を置いた設計となっている。

DQN

Deep Q-Network。

Q学習と深層ニューラルネットワークを組み合わせ、

画像入力から直接行動を決定できるようにした画期的手法。

従来のQ学習では状態数が爆発し現実問題に適用困難であったが、

DQNではCNNなどを用いて高次元入力(ゲーム画面など)を直接処理できる。

学習安定化のために、

経験再生(Replay Buffer)と

ターゲットネットワークという2大工夫が導入されている。

これにより学習の発散を防ぎ、安定した収束が可能となった。

G検定では「DQN=深層学習+Q学習+安定化テクニック」の3点セットが重要。

OpenAI Five

複雑な戦略ゲーム「Dota 2」において、

世界トップクラスのプロチームを破ったマルチエージェント強化学習システム。

5体のエージェントが協力・分業・連携しながら戦う必要があり、

極めて高度な戦術理解とリアルタイム判断が求められる。

大規模分散学習、自己対戦(Self-play)、

カリキュラム学習などを組み合わせ、

人間の戦略を超えるチームプレイを実現した。

PPO

Proximal Policy Optimization。

方策勾配法において、更新幅を制限(クリッピング)することで、

学習の不安定化を防ぎつつ高い性能を実現したアルゴリズム。

従来の方策勾配法は、更新が大きすぎると学習が破綻する問題があったが、

PPOでは「急激に方策を変えない」制約を加えることで、

安定した学習と実装容易性を両立した。

現在、ロボット制御・ゲームAI・RLHF など、

実運用レベルで最も広く用いられている手法の一つ。

Rainbow

DQNの性能向上のために提案された複数の改良技術を、

すべて統合した最強クラスのDQN拡張モデル。

Rainbow は、以下の 7つの要素 を組み合わせて構成される。

- ① Double Q-learning(理論基盤):行動選択と価値評価を分離し、Q値の過大評価を抑制する理論。

- ② Double DQN:Double Q-learning を深層学習に適用し、学習の安定性を向上。

- ③ Prioritized Experience Replay:重要な経験を優先的に学習し、収束を高速化。

- ④ Dueling Network:Q値を「状態価値 V」と「行動優位性 A」に分解し、学習効率を改善。

- ⑤ Multi-step Learning(n-step 学習):複数ステップ先の報酬まで考慮し、学習を加速。

- ⑥ CategoricalDQN:報酬の分布を学習することで、より正確な予測を行う。

- ⑦ Noisy Network:ネットワークにノイズを加え、自律的な探索行動を促進。

G検定では「DQN改良技術の集大成」 「7つの技術の統合モデル」として 出題されることが多く、構成要素の暗記は必須である。

RLHF

Reinforcement Learning from Human Feedback(人間のフィードバックを用いた強化学習)。

AIの出力に対して人間が「良い・悪い」などの評価を与え、

それを報酬モデルとして学習し、

強化学習によってAIの振る舞いを人間の好みに近づける技術。

ChatGPTなどの大規模言語モデル(LLM)の安全性・有用性向上に不可欠であり、

PPOと組み合わせて最適化されるケースが多い。

G検定では「LLMの調整」「人間の好みへの最適化」「PPOとの組み合わせ」が頻出。

sim2real

シミュレーション環境(sim)で学習したモデルを、

現実環境(real)へ転移・適用する技術。

ロボット制御などの分野では、

実環境での試行錯誤がコスト・危険・時間の面で困難なため、

まず仮想空間で大量学習させ、その成果を現実に持ち込む。

この際、シミュレーションと現実の差(Reality Gap)が問題となるため、

ドメインランダマイゼーションなどと併用される。

アルファスター

DeepMindが開発した「スタークラフト2」用AI。

非常に広大な状態空間・行動空間を持つリアルタイム戦略ゲームにおいて、

プロプレイヤーを破る成果を達成。

模倣学習+自己対戦型強化学習+マルチエージェント学習

を組み合わせ、戦略構築能力と反応速度の両立を実現。

G検定では「OpenAI Five(Dota2)」との対比で出題されやすい。

オフライン強化学習

環境との新たな試行錯誤を行わず、

既に収集された固定データのみから方策を学習する手法。

医療・金融・製造など、

試行錯誤が危険・高コスト・非倫理的な分野で重要。

従来の強化学習は「探索」が前提であるが、

オフラインRLでは分布外行動の暴走(外挿誤差)を防ぐ工夫が必要となる。

残差強化学習

従来制御(PID制御など)の出力に対し、

その誤差(残差)だけを強化学習で補正するハイブリッド制御手法。

完全に強化学習へ任せるのではなく、

安全で安定な従来制御をベースとするため、

ロボット制御など実システムへの適用が容易。

状態表現学習

画像などの高次元入力から、

強化学習に本質的な情報だけを抽出し、

低次元で意味のある状態表現を学習する技術。

学習の高速化・安定化・汎化性能向上に大きく貢献。

ダブル DQN

DQNが持つ「Q値の過大評価問題」を解決するため、

行動選択と価値評価を分離した手法。

過大評価が抑制されることで、

学習がより安定し、実環境への適用性能が向上。

デュエリングネットワーク

Q値を「状態価値V」と「行動優位性A」に分解して推定する構造。

これにより、

行動に依らず状態自体が良いか悪いかを正確に評価可能となり、

学習効率が向上。

ドメインランダマイゼーション

シミュレーション環境の物理パラメータや見た目を

学習時にランダム変化させることで、

現実環境のばらつきに強いモデルを作る技術。

sim2real問題の代表的解決策。

ノイジーネットワーク

ネットワーク重みに意図的にノイズを加えることで、

探索行動を自動生成させる仕組み。

ε-greedy のような手動探索制御を不要にし、

学習の自律性を高める。

報酬成形

ゴール到達時のみ報酬が得られる難課題に対し、

途中経過にも小さな報酬を与える設計手法。

学習初期の探索停滞(報酬スパース問題)を防ぐ。

マルチエージェント強化学習

複数のエージェントが同一環境で学習し、

協調・競争・分業を通して戦略を獲得する枠組み。

例:ロボット群制御、対戦ゲーム、交通制御。

連続値制御

行動が離散値ではなく、

連続値(角度・速度・力など)で表される制御問題。

ロボットアーム制御や自動運転で必須。

PPO、DDPG、SAC などの手法が用いられる。

30. データ生成

CycleGAN

ペアデータ不要で、2つの異なるドメイン間の画像変換を学習できるGANの一種。Cycle Consistency制約により、変換前後の意味情報を保ちつつ、高品質なスタイル変換を実現する。

DCGAN

畳み込みニューラルネットワーク(CNN)をGANに導入し、画像生成の安定性と品質を大幅に向上させたモデル。バッチ正規化や層構成の最適化により、安定した学習と高精度な生成を可能にする。

Diffusion Model

データに徐々にノイズを加える拡散過程と、その逆過程を学習することで、ノイズからデータを生成する確率モデル。近年の高品質画像生成の主流手法であり、GANよりも安定した学習が可能である。

NeRF

少数の2次元画像から、空間中の光線情報をニューラルネットワークで表現し、連続的な3次元表現を構築する手法。自由視点からの高精細な画像生成が可能で、3D復元分野で注目されている。

Pix2Pix

入力と出力が対応したペアデータを用いて学習する条件付きGAN。線画から写真生成など、画像変換タスクで高い再現性を示す代表的手法である。

音声生成

テキストなどの情報から、自然な人間の声を音声波形として生成する技術。WaveNetやDiffusion Modelが代表例で、高品質な音声合成を実現する。

画像生成

学習データをもとに、実在しない新規画像をピクセル単位で生成するタスク。GANやDiffusion Modelが用いられ、創作支援やデータ拡張に活用される。

敵対的生成ネットワーク (GAN)

生成器と識別器を競わせる敵対的学習により、本物と区別できないデータ生成を実現するモデル。画像・音声・文章生成など、幅広い生成タスクの基盤技術となっている。

- 生成器(Generator):ランダムノイズなどから本物らしいデータを生成する。

- 識別器(Discriminator):入力データが本物か偽物かを判別する。

文章生成

与えられた文脈から、意味的に整合した自然な文章を生成する自然言語生成タスク。Transformerや大規模言語モデルにより、高精度な文章生成が可能となっている。

31. 転移学習・ファインチューニング

Few-shot

数個程度の極めて少ない学習サンプルのみを用いて、未知のタスクに適応する学習形態。事前学習済みモデルと組み合わせることで、高い汎化性能を実現する。

One-shot

たった1つの学習データのみから未知のタスクに適応する学習形態。特徴表現の汎化能力が重要で、顔認証などの分野で活用される。

自己教師あり学習

ラベルを用いず、擬似的な教師信号(Pretext Task)を自動生成して特徴を学習する手法。大量の未ラベルデータを活用でき、事前学習として有効である。

事前学習

本来のタスクに取り組む前に、大規模データを用いて汎用的な特徴表現を獲得させる学習プロセス。転移学習の性能向上に大きく寄与する。

事前学習済みモデル

大規模データセットで学習済みの汎用モデルであり、他タスクへ再利用可能である。転移学習やファインチューニングの基盤として用いられる。

破壊的忘却

新しいタスクの学習により、過去の知識が急激に失われる現象。継続学習(Continual Learning)における主要課題であり、正則化などで抑制を試みる。

半教師あり学習

少量のラベル付きデータと大量のラベルなしデータを併用し、学習効率と性能を高める手法。ラベル付けコスト削減に有効である。

32. マルチモーダル

CLIP

画像とテキストを共通のベクトル空間に埋め込み、両者の類似度学習を行うモデル。学習データに含まれないクラスに対しても推論可能なゼロショット学習を実現する。

DALL-E

入力されたテキストプロンプトの意味を理解し、それに対応する高品質な画像を生成するモデル。Transformerベース(DALL-E 1)およびDiffusion Modelベース(DALL-E 2以降)の構成を採用し、Text-to-Image分野を代表する生成AIである。

Flamingo

視覚情報とテキスト情報を統合的に処理し、Few-shotで対話・推論を可能にするマルチモーダルモデル。画像や動画に対する質問応答など、高度な理解能力を示す。

Image Captioning

画像を入力として、その内容を説明する自然言語文を自動生成するタスク。CNNとRNN / Transformerを組み合わせたモデル構成が一般的である。

Text-To-Image

テキストによる指示(プロンプト)を入力として、対応する画像を生成する技術の総称。Diffusion Modelが主流手法として用いられる。

Visual Question Answering (VQA)

画像と質問文を入力し、画像内容に基づいて正解を出力するマルチモーダル推論タスク。視覚理解と言語理解の統合が求められる。

Unified-IO

画像認識、文章生成、セグメンテーションなど、異なる形式の入出力タスクを単一モデルで統合的に処理するフレームワーク。マルチタスク学習と統一表現が特徴である。

Zero-shot

学習時に未経験のクラスやタスクに対して、追加学習なしで推論を行う能力。事前学習モデルと意味空間の一般化が鍵となる。

基盤モデル

膨大なデータで事前学習された大規模汎用モデルであり、微調整により多様なタスクへ適応可能。生成AIやマルチモーダルAIの中核技術である。

マルチタスク学習

関連する複数タスクを同時に学習させ、共通特徴を共有することで性能向上を図る手法。過学習の抑制や汎化性能向上にも寄与する。

33. モデルの解釈性

CAM

CNNが画像中のどの領域に注目して分類したかを、特徴マップの重み付き和としてヒートマップ化する可視化手法。グローバルアベレージプーリング(GAP)層を使用したモデル(ResNetなど)でしか使えない。

Grad-CAM

勾配情報を用いて重要領域を可視化するCAMの拡張手法。全結合層を含むなど、様々なCNN構造に適用可能であり、実用性が高い。

LIME

入力周辺に擬似データを生成し、局所的に線形モデルで近似することで予測根拠を説明する手法。モデル非依存で幅広く適用できる。

Permutation Importance

特徴量をランダムにシャッフルした際の性能低下量から重要度を評価する手法。モデル非依存で直感的に解釈できる一方、特徴量間の相関が強い場合に重要度が過小評価されやすいという欠点がある。

SHAP

シャープレイ値に基づき、各特徴量の予測への寄与度を公平に分解する手法。局所・大域の両方の解釈が可能である。

説明可能 AI (XAI)

ブラックボックス化しやすいAIの判断根拠を、人間が理解可能な形で提示する技術の総称。医療・金融など高い信頼性が求められる分野で特に重要視される。

34. モデルの軽量化

エッジ AI

データをクラウドに送らず、端末側(エッジ)で推論処理を行う仕組み。低遅延・通信量削減・プライバシー保護の観点から重要視される。

蒸留

高性能な教師モデルの出力を、軽量な生徒モデルに学習させることで、精度を保ちつつ軽量化する手法。知識蒸留(Knowledge Distillation)とも呼ばれる。

宝くじ仮説

巨大なニューラルネットワークの中には、初期化時点で既に高性能な小規模サブネットワーク(当たりくじ)が含まれているという仮説。学習後に不要な重みを除去(プルーニング)し、この部分構造のみを抽出・再学習することで、精度を維持したまま大幅なモデル軽量化が可能となる。効率的なモデル設計や省メモリ化に重要な理論的基盤である。

プルーニング

予測への寄与が小さい重みやニューロンを削除し、モデルサイズや計算量を削減する手法。推論の高速化とメモリ削減に有効である。

モデル圧縮

精度をできるだけ維持したまま、モデルサイズや計算量を削減する技術の総称。量子化・蒸留・プルーニングなどが代表例である。

量子化

パラメータを32bit浮動小数点数から8bit整数などへ変換し、メモリ削減と高速化を実現する手法。精度低下とのトレードオフが生じる。

35. AI プロジェクトの進め方

AI のビジネス活用

AI技術を研究目的にとどめず、業務効率化・コスト削減・新規価値創出など、実ビジネスの課題解決に活用すること。技術起点ではなく課題起点での導入が成功の鍵となる。

AI プロジェクトの進め方

課題設定 → PoC → 開発 → 運用・評価の反復型プロセスで進めるのが一般的。試行錯誤を前提とする点が、従来型システム開発と大きく異なる。

BPR

Business Process Re-engineeringの略で、AI導入を契機に業務プロセスや組織構造を抜本的に再設計する取り組み。部分最適ではなく全体最適を目指す。

CRISP-DM

データマイニングの標準プロセスモデルで、「ビジネス理解 → データ理解 → データ準備 → モデリング → 評価 → 展開」の6段階で構成される。

CRISP-ML

CRISP-DMを機械学習プロジェクト向けに拡張したモデル。運用後のモニタリング・再学習工程を重視する点が特徴である。

Docker

OSやライブラリを含めて実行環境をコンテナ化する仮想化技術。環境差異によるトラブルを防ぎ、再現性の高いAI開発・運用を可能にする。

Jupyter Notebook

コード・実行結果・説明文を一体化して扱える対話型開発環境。データ分析・可視化・モデル検証における標準ツールである。

MLOps

機械学習と運用を統合し、データ収集・前処理・学習・評価・デプロイ・監視・再学習までの一連の工程を自動化・継続管理するための仕組み。モデルの性能劣化(データドリフト)への対応や、安定した本番運用を実現するために不可欠である。

PoC

PoC(Proof of Concept、概念実証)とは、技術的実現可能性や業務適用可能性を検証する段階を指す。ガイドラインでは、この段階で検証を行い、その結果を踏まえて本開発へ進むか判断する段階的契約が推奨されている。

Python

NumPyやPyTorchなど豊富なAIライブラリと簡潔な文法を持つ言語。AI・機械学習開発のデファクトスタンダードである。

Web API

インターネット(HTTP/HTTPS)を介して、外部のプログラムやサービスから機能やデータを利用するためのインターフェース。

システム間連携の標準的な仕組みであり、データ取得、投稿、更新、削除などをプログラムから実行できる。

AI分野では、学習済みモデルをAPIとして公開し、画像認識、音声認識、自然言語処理などのAI機能を、

アプリケーションや業務システムから簡単に呼び出して利用する目的で用いられる。

アジャイル

短期間で計画・実装・検証を反復し、柔軟に仕様変更を行う開発手法。不確実性が高いAI開発に適した方式である。

ウォーターフォール

工程を順序通りに一方向で進める開発手法。後戻りが困難なため、試行錯誤を要するAI開発には不向きな場合が多い。G検定ではアジャイル開発とよく対比される。

オープン・イノベーション

企業・大学・自治体など外部組織と連携し、知識や技術を共有して新たな価値を創出する考え方。AI開発の加速に有効である。

クラウド

インターネットを通じて、サーバー、ストレージ、ネットワーク、データベース、ソフトウェアなどのITリソースを、

必要な分だけオンデマンドで利用できるサービス形態。

初期投資を抑え、柔軟な拡張性(スケーラビリティ)と高い可用性を実現できる点が特徴である。

AI分野では、GPUやTPUなどの高性能計算資源を活用した大規模学習、

分散処理、推論サービスのデプロイ基盤として利用され、

大量データを扱う機械学習・深層学習に不可欠なインフラとなっている。

代表例としてAWS、GCP、Azureなどがある。

産学連携

企業と大学・研究機関が協力し、研究成果の社会実装や共同研究を推進する取り組み。先端AI技術の事業化に重要である。

ステークホルダーのニーズ

経営層・現場・IT部門など利害関係者の要求や期待。AIプロジェクト成功には合意形成が不可欠である。

データサイエンティスト

統計・機械学習・プログラミング・ビジネスの知識を横断的に活用し、データから価値を創出する専門職。

他企業や他業種との連携

異業種間でデータ・知見を共有し、新たな価値を共創する取り組み。AIの社会実装促進に重要である。

36. データの収集・加工・分析・学習

アノテーション

教師あり学習のために、画像やテキストなどのデータに対して正解ラベル(タグ、クラス、バウンディングボックス、セグメンテーション領域など)を付与する作業。 学習データの品質がモデル精度を大きく左右するため、アノテーションの正確性と一貫性が極めて重要である。 G検定では、教師あり学習の前提条件として頻出。

オープンデータセット

企業や研究機関などが公開し、誰でも(あるいは条件付きで)無償で利用できる学習・評価用のデータセット。 CIFAR-10、MNIST、ImageNet、COCO などが代表例であり、 モデル性能の客観的比較(ベンチマーク)に用いられる。 G検定では、代表的データセット名と用途が頻出。

コーパス

自然言語処理の研究や学習のために収集・構造化された、大規模なテキストデータの集合体。 言語モデル、機械翻訳、感情分析、文書分類などの学習に用いられ、 コーパスの規模と品質が言語モデルの性能を大きく左右する。

データリーケージ

学習データの中に、本来テスト時まで知る由もない将来情報(正解ラベル、統計量、目的変数由来特徴量など)が誤って混入し、 実力以上の評価が出てしまう現象。 汎化性能の過大評価を引き起こす重大な問題であり、 交差検証や時系列分割、前処理の分離などによる対策が重要。 G検定では、機械学習の評価設計における注意点として頻出。

37. 数理・統計

移動平均

時系列データにおいて、短期的な変動(ノイズ)を平滑化し、 長期的なトレンドを把握するために、 一定区間の平均値を時点ごとにずらしながら算出する手法。 需要予測、株価分析、センサーデータの前処理などで広く用いられる。 G検定では時系列処理・前処理手法として出題。

確率分布

確率変数がとりうる値と、それぞれが出現する確率の対応関係を表したもの。 離散型(二項分布・ベルヌーイ分布)と連続型(正規分布・ポアソン分布)に分類される。 機械学習では誤差分布の仮定や 確率モデルの設計の基礎となる。

確率変数

試行結果によって値が確率的に決まる変数。 離散型(クラスラベル、成功回数など)と連続型(身長、誤差量など)に分類される。 確率分布は、この確率変数の振る舞いを数学的に記述する。

確率密度

連続確率分布において、ある値の周辺にデータが出現する 確率の濃さを表す関数。 確率そのものではなく、積分によって確率が求まる点が重要。 正規分布の曲線が典型例。

疑似相関

直接的な因果関係が存在しないにもかかわらず、 第三の要因などによって相関があるように見えてしまう現象。 機械学習では、無意味な特徴量に依存した誤学習を引き起こす原因となる。

※例として、「アイスクリームの売上」と「水難事故の発生件数」は強い相関を示すが、 実際の原因は気温の上昇という共通要因であり、両者に直接の因果関係はない。

期待値

確率変数の各値にその確率を掛けて総和を取った値。 多数回試行を行った際に得られる平均的な結果を表す。 損失関数の期待値最小化は、機械学習の学習原理そのもの。

帰無仮説

統計的検定において「差がない・効果がない」と仮定する仮説。 データによってこの仮説を棄却できるかを検証する。

共分散

2つの変数が同時にどの方向へ変動するかを表す指標。 正なら同方向、負なら逆方向。 相関係数は、共分散を正規化した指標である。

コサイン類似度

2つのベクトルのなす角のコサイン値により、 向きの近さを評価する類似度指標。 文書検索、文章埋め込み、画像特徴量比較などで多用される。

最小二乗法

観測値と予測値の誤差二乗和を最小化することで、 回帰モデルの最適パラメータを求める方法。 線形回帰・重回帰の基礎理論であり、 G検定では回帰分析の根幹として頻出。

最頻値

データの中で最も多く出現する値。

最尤法

観測データが得られる確率(尤度)を最大にするように モデルのパラメータを推定する方法。 統計モデル・深層学習の損失最小化と数学的に対応する。

条件付き確率

事象Aが起きた条件のもとで事象Bが起こる確率。 ベイズの定理の基礎概念であり、 ベイズ推定・ベイズ分類器の理論的基盤。

正規分布

平均を中心とする釣鐘型の連続確率分布。 自然現象・誤差分布・ノイズモデルに広く現れ、 機械学習における誤差モデルの標準仮定。 G検定では最頻出分布。

相関係数

2変数間の線形関係の強さを -1〜1 で表す指標。 特徴量選択や探索的データ解析で活用される。

相互情報量

2つの確率変数がどれだけ互いに情報を共有しているか(依存しているか)を表す尺度。 値が大きいほど強い依存関係を持ち、片方を知ることで他方の不確実性が大きく減少する。 一方、0に近い場合は独立に近いことを意味する。 線形関係だけでなく非線形な関係も捉えられるため、特徴量選択で重要。

対立仮説

帰無仮説が棄却された際に採択される、「差がある」「効果がある」という仮説。

中央値

データを昇順に並べたときの中央の値。 外れ値の影響を受けにくい代表値。

度数分布

データを区間ごとに分け、それぞれの出現回数を集計した分布。 ヒストグラムで可視化される。

二項分布

成功確率pのベルヌーイ試行をn回行ったときの 成功回数の分布。 分類問題の理論基盤。

外れ値

大多数のデータから大きく逸脱した値。 ノイズの可能性もあるが、異常検知では重要な意味を持つ。

標準偏差

分散の平方根で、データのばらつきを表す代表的指標。

平均

全データの総和を個数で割った代表値。

偏相関係数

第三の変数の影響を統計的に取り除いた上で、 2つの変数間の純粋な相関関係を評価する指標。 例えば、「気温」が「アイス売上」と「ビール売上」の両方に影響する場合、 気温の影響を除去して、両者の直接的な関係のみを測定できる。 疑似相関の検出や因果関係の推定補助に有効。

ポアソン分布

一定の時間や空間内で、稀に発生する事象の回数が従う確率分布。 単位時間あたりの平均発生回数をλ(ラムダ)とし、 その間に何回事象が起こるかをモデル化する。 例えば、「1時間あたり平均2件の問い合わせが来るコールセンターで、次の1時間に3件来る確率」や、 「1日に平均5件の不良品が出る製造ラインで、今日7件出る確率」などを表す。 機械学習では異常検知やイベント発生予測で活用され、 G検定では二項分布との違いと具体例の理解が頻出。

マハラノビス距離

データの分散と相関構造を考慮して計算される多変量距離尺度。 各次元を独立に扱うユークリッド距離と異なり、 相関が強い方向の距離は相対的に短く、 ばらつきの小さい方向の距離は相対的に長く評価する。 これにより、データ分布の形状(楕円形)に沿った距離計算が可能となり、 外れ値検出や異常検知で高い性能を発揮する。

ユークリッド距離

最も基本的な距離尺度。 k近傍法・クラスタリングなど 距離ベース学習の基盤。

【法律・倫理分野】

1. 個人情報保護法

GDPR

GDPR(EU一般データ保護規則)は、EU域内の個人データを厳格に保護するための包括的な法規制であり、域外企業(日本含む)にも適用される点が特徴である。違反時には全世界年間売上高の最大4%または2,000万ユーロという高額な制裁金が科されるため、越境データ移転や同意取得の要件がG検定で頻出となる。

日本の個人情報保護法に比べ、GDPRは域外適用が強力であり、違反時の制裁金が極めて高額である点が大きな違いである。

仮名加工情報

仮名加工情報とは、他の情報と照合しない限り特定の個人を識別できないように加工された情報である。匿名加工情報とは異なり、事業者の内部利用に限って利用目的の変更が可能という点が試験で問われやすい。

個人識別符号

個人識別符号とは、それ単体で特定の個人を識別できる符号を指し、指紋・顔認証データなどの生体情報や、マイナンバー、免許証番号などが該当する。氏名などの記述がなくても個人情報に該当する点が重要であり、個人情報の一部として位置づけられる。

個人データ

個人データとは、個人情報データベース等を構成する検索可能な個人情報のことである。つまり、個人情報のうち「体系的に整理・検索できる状態」のものが個人データに該当する。個人情報 ⊃ 個人データの関係を正確に区別できるかが重要。

個人情報

個人情報とは、生存する個人を識別できる情報、または個人識別符号を含む情報を指す。氏名や住所などの記述情報に加え、個人識別符号を含めば、それ単体でも個人情報となる。なお、すべての個人データは個人情報に含まれるが、逆は成り立たない点が頻出である。

第三者提供

第三者提供とは、個人データを本人以外の第三者に提供することであり、原則として本人の同意が必要である。ただし、法令に基づく場合や委託などの例外がある点が頻出である。

匿名加工情報

匿名加工情報とは、特定の個人を識別できず、かつ復元できないように加工された情報である。本人の同意なしに第三者提供や利活用が可能な点が、仮名加工情報との重要な違いである。

保有個人データ

保有個人データとは、事業者が開示・訂正・利用停止などの権限を有する個人データを指す。法改正により、6か月以内に消去されるデータも対象に含まれる点が重要である。

要配慮個人情報

要配慮個人情報とは、人種・信条・病歴・犯罪歴など、差別や不利益が生じやすい情報を指す。取得時には原則として本人の同意が必要であり、特に厳格な管理が求められる。

利用目的

利用目的とは、個人情報をどのような目的で利用するかを具体的に特定したものである。取得時には本人への通知または公表が義務付けられており、目的外利用の禁止が重要論点となる。

委託

委託とは、利用目的の達成に必要な範囲で個人データの取り扱いを外部事業者に任せることである。第三者提供には該当せず本人同意は不要だが、委託先への適切な監督義務が生じる。

2. 著作権法

創作性

創作性とは、著作者の個性や工夫が何らかの形で表現されていることを指し、著作物として保護されるための重要な要件である。単なる事実の羅列やありふれた表現には原則として創作性は認められない点が試験で頻出である。

著作物

著作物とは、思想または感情を創作的に表現したもので、文芸・学術・美術・音楽の範囲に属するものを指す。プログラムも著作物に含まれるため、AI開発におけるソースコードや学習データの扱いが重要論点となる。

AI 生成物

AI生成物とは、AIによって自動的に生成された文章・画像・音声などのコンテンツを指す。人の創作的寄与がない場合は原則として著作物に該当せず、著作権は発生しないとされる点が、G検定で特に重要である。

利用規約

利用規約とは、Webサービス等の利用条件を定めた契約であり、データの二次利用やAI学習への利用可否が規定されている場合がある。契約は著作権法より優先される場合があるため、規約違反が法的リスクにつながる点が重要である。

著作権侵害

著作権侵害とは、著作権者の許諾なく著作物を複製・翻案・公衆送信などする行為を指す。ただし、私的使用や情報解析目的のAI学習(著作権法30条の4)など、例外的に適法とされる場合がある。

著作権

著作権とは、著作物を独占的に利用できる排他的な権利であり、創作と同時に自動的に発生する。AI分野では、①学習段階と②生成物の利用段階の2方向から理解することが重要である。

学習段階では、情報解析目的の利用(著作権法30条の4)により、原則として著作物をAI学習に使用することが可能とされている。一方、生成物の利用では、既存の著作物と類似性・依拠性が認められる場合、著作権侵害となる可能性があり、この区別がG検定の重要論点である。

3. 特許法

発明

発明とは、自然法則を利用した技術的思想の創作のうち高度なものを指す。AI分野では、学習アルゴリズムやモデル構造、制御方法などはプログラムとして発明の対象になり得る点が重要である。

新規性

新規性とは、特許出願時点で公知でないことを意味し、すでに論文やWeb、製品として公開されている技術は新規性を失う。公開前の出願が原則という点が試験で問われやすい。

進歩性

進歩性とは、その分野の通常の知識を持つ者が容易に想到できないことを指す。既存技術の単なる組み合わせでは進歩性が認められにくい点が重要である。

知的財産権

知的財産権とは、人間の知的活動によって生み出されたアイデアや創作物を保護する権利の総称である。特許権・著作権・商標権・意匠権などの違いを整理して理解することが重要である。

発明者

発明者とは、実際に発明を行った自然人を指す。現行法ではAI自体は発明者として認められず、人間の関与が法的に不可欠である点がG検定の重要論点である。

職務発明

職務発明とは、従業員がその職務に関連して行った発明であり、特許法第35条により定義されている。契約や就業規則により、特許を受ける権利を最初から会社に帰属させることが可能であるが、発明者への相当な対価(報酬)の支払いが義務付けられている点が重要である。

特許権

特許権とは、発明を独占的に実施できる産業財産権である。出願後、審査を経て登録されて初めて発生する点が、著作権との大きな違いである。

4. 不正競争防止法

営業秘密

営業秘密とは、秘密管理性・有用性・非公知性の3要件をすべて満たす技術情報や営業情報を指す。AI分野では、学習済みモデルや重みパラメータ、学習データの管理手法などが該当する場合がある。

- 秘密管理性:アクセス制限や管理ルールにより、秘密として適切に管理されていること

- 有用性:事業活動に役立つ技術情報または営業情報であること

- 非公知性:一般に公開されておらず、容易に入手できないこと

限定提供データ

限定提供データとは、業として特定の者に提供される技術的または営業上の情報であり、営業秘密よりも緩やかな保護制度として創設された。ビッグデータの利活用促進と権利保護の両立が目的である。保護を受けるために以下の3要件を満たす必要がある。

- 限定提供性:不特定多数ではなく、契約等に基づき特定の者のみに提供されていること

- 相当蓄積性:相当量蓄積されたデータであり、事業活動に有用であること

- 電磁的管理性:電磁的方法により管理され、容易に複製・配布できない管理がなされていること

5. 独占禁止法

競争制限

競争制限とは、カルテルや入札談合などにより市場における自由な競争を実質的に制限する行為を指す。AIによる自動価格設定アルゴリズムが協調的な価格操作を引き起こす可能性が、近年の重要論点となっている。

公正競争阻害性

公正競争阻害性とは、事業者の行為が市場における公正な競争を妨げるおそれがあることを指す。巨大プラットフォーマーによるデータの囲い込みや排他的取引が、AI・デジタル分野で特に問題視されている。

6. AI開発委託契約

AI・データの利用に関する契約ガイドライン

AI・データの利用に関する契約ガイドラインは、経済産業省が策定したAI開発・データ利活用契約の実務指針である。開発プロセスを探索的段階・PoC段階・本開発段階などに分け、権利帰属や責任分担、契約形態を段階的に整理する考え方がG検定で頻出である。

NDA

NDA(Non-Disclosure Agreement、秘密保持契約)とは、取引や共同開発で知り得た相手方の秘密情報を第三者に漏らさないことを約束する契約である。AI開発では、学習データやモデル構造、業務ノウハウの漏洩防止の観点から極めて重要である。

請負契約

請負契約とは、仕事の完成を約束し、その成果物に対して報酬が支払われる契約である。成果完成責任を負うため、不確実性が高いAI開発ではリスクが大きく、適用が難しい場合がある点が重要である。

準委任契約

準委任契約とは、事務処理の遂行自体を目的とし、善管注意義務をもって業務を行う契約である。成果完成責任を負わないため、不確実性の高いPoC段階のAI開発で多用される。

委任契約が法律行為の処理を対象とするのに対し、準委任契約は事実行為や技術業務を対象とする点が重要な違いである。

精度保証

精度保証とは、AIモデルが特定の正解率や性能水準を満たすことを契約で保証することを指す。AIはデータ依存性が高く性能変動が大きいため、事前に数値保証することは極めて困難であり、実務上の重要な注意点となる。

PoC

PoC(Proof of Concept、概念実証)とは、技術的実現可能性や業務適用可能性を検証する段階を指す。ガイドラインでは、この段階で検証を行い、その結果を踏まえて本開発へ進むか判断する段階的契約が推奨されている。

保守契約

保守契約とは、開発後のシステム運用支援や不具合対応を行う契約である。AIシステムでは、データ変化による精度劣化(ドリフト)への対応や再学習の範囲を契約で明確化することが重要である。

7. AIサービス提供契約

SaaS

SaaS(Software as a Service)とは、ソフトウェアを製品として販売せず、インターネット経由でサービスとして提供する形態である。初期導入コストが低く、継続的に機能改善が行われる点が特徴で、AIサービス提供の主要モデルとなっている。

データ利用権

データ利用権とは、法的な所有権が存在しないデータに対して、契約により定められた利用権限を指す。AIサービスでは、誰がどの範囲で学習・分析・二次利用できるかを明確化することが、紛争防止の観点から重要である。

利用規約

利用規約とは、多数の利用者に画一的に適用される契約条件を定めたもので、SaaSにおける基本的な契約形態である。ユーザー入力データをAI学習に利用できる条項が含まれることが多く、データ利用範囲の確認が重要である。

精度保証

ここでの精度保証とは、SLA(Service Level Agreement)に基づくサービス品質保証を指す。AI APIなどでは、稼働率や応答時間は保証しても、出力結果の正確性(Accuracy)までは保証しないのが一般的である。

8. 国内外のガイドライン

AI 倫理

AI倫理とは、AIの開発・利用において遵守すべき道徳的規範を指す。主なテーマとして、公平性、プライバシー保護、透明性、説明責任、安全性などが挙げられ、社会からの信頼確保の基盤となる。

AI ガバナンス

AIガバナンスとは、組織がAIのリスクを適切に管理し、AI倫理を実践するための体制やプロセスのことである。方針策定、監督体制、教育、監査などを通じて、AIの適正利用を担保する。

価値原則

価値原則とは、「人間中心のAI社会原則」などで示される、AIが目指すべき基本的な価値観を指す。具体的には、人間尊重、多様性の尊重、包摂性、公平性、持続可能性などが含まれる。

ハードロー

ハードローとは、法律や条約など、国や公的機関が制定し、法的な拘束力や罰則を伴うルールを指す。EUのAI規則(AI Act)などが代表例であり、遵守義務が明確である点が特徴である。

ソフトロー

ソフトローとは、ガイドラインや行動規範など、法的拘束力はないが社会的遵守が期待されるルールである。技術進展が速いAI分野では、柔軟かつ迅速に対応できる枠組みとして重要な役割を果たす。

リスクベースアプローチ

リスクベースアプローチとは、AIを一律に規制せず、想定されるリスクの大きさに応じて規制の強度を変える考え方である。医療・自動運転・採用選考など高リスク領域には厳格な規制を、低リスク領域には緩やかな規制を適用する。

9. プライバシー

カメラ画像利活用ガイドブック

店舗や公共空間に設置された防犯カメラ等の画像を、防犯以外の目的(マーケティング、混雑分析、業務改善など)で利活用する際に、プライバシーへ配慮した適切な運用を行うための指針を示したガイドライン(IoT推進コンソーシアム策定)。

- 目的明確化: 利用目的を具体的かつ明確にし、目的外利用を行わない。

- 通知・公表: 撮影・利用の事実や目的を掲示等により利用者に周知する。

- データ最小化: 必要最小限の範囲で取得・保存・利用を行う。

- 安全管理: 不正アクセスや漏えい防止のための技術的・組織的安全管理措置を講じる。

プライバシー・バイ・デザイン

システムやサービスの企画・設計段階から、あらかじめプライバシー保護を組み込むという設計思想。 カナダ・オンタリオ州の情報プライバシーコミッショナーが提唱した 7つの基本原則が国際的に参照されている。

- ① 事前予防的であること(Proactive not Reactive): 事後対応ではなく、プライバシー侵害の発生を未然に防止する設計とする。

- ② デフォルトでプライバシー保護(Privacy as the Default): 何もしなくても最大限のプライバシーが保護される設定を標準とする。

- ③ 設計への組込み(Privacy Embedded into Design): プライバシー保護を後付けせず、システム設計の中核に組み込む。

- ④ 機能性とプライバシーの両立(Full Functionality – Positive-Sum): 利便性やビジネス価値とプライバシーをトレードオフにせず、両立を目指す。

- ⑤ ライフサイクル全体での保護(End-to-End Security): 取得から保存、利用、廃棄に至るまで、全過程で安全管理措置を講じる。

- ⑥ 可視性と透明性(Visibility and Transparency): データ処理の内容を検証可能とし、説明責任を果たす。

- ⑦ 利用者中心(Respect for User Privacy): 利用者の権利・利益を最優先し、同意や選択の自由を尊重する。

10. 公平性

アルゴリズムバイアス

学習データや設計上の問題により、AIが特定の属性に不利・有利な判断をしてしまう偏りのこと。性別や人種などのセンシティブ属性に関する差別を助長する危険があり、社会的・倫理的問題として重視される。公平なAI設計には、データ収集段階からの対策が不可欠である。

公平性の定義

AIの判断結果をどのような基準で「公平」とみなすかの考え方で、機会の均等、結果の平等、較正など複数の定義が存在する。これらは同時にすべて満たすことが理論的に困難とされ、公平性の不可能性定理として知られている。目的に応じて、どの公平性指標を採用するかの判断が重要となる。

サンプリングバイアス

母集団を正しく代表しない偏ったデータを収集してしまうことで生じる偏りのこと。特定の年齢層や地域、性別のデータが過剰・不足すると、AIの予測結果に不公平が生じやすくなる。データ収集段階での代表性確保が重要な対策となる。

センシティブ属性

人種、性別、宗教、障害の有無など、差別や不利益につながりやすい配慮が必要な属性のこと。入力変数から除外しても、他の特徴量から間接的に推測される場合があり、代理変数問題が生じる。AIの公平性確保には、これらの影響を考慮した設計が不可欠である。

代理変数

センシティブ属性そのものではないが、強い相関を持つために間接的に差別を引き起こす変数のこと。例えば、居住地域が人種や所得層の推定につながる場合が該当する。入力特徴量の選択と相関分析が対策として重要である。

データの偏り

現実社会に存在する偏見や不平等が学習データに反映されてしまうこと。これを学習したAIは差別的判断を再生産・増幅する恐れがあり、倫理的に大きな問題となる。前処理によるバイアス除去や継続的な検証が求められる。

※実例として、Amazonの採用AIが過去の男性中心の採用履歴を学習し、女性候補者を不利に評価した事例が知られており、データの偏りが差別を助長する危険性を示している。

11. 安全性とセキュリティ

Adversarial Attack (Adversarial Examples)

人間にはほとんど認識できない微小なノイズを入力データに加え、AIを意図的に誤認識させる攻撃手法。画像認識や音声認識で深刻な問題となっており、安全性を脅かす代表的な攻撃としてG検定でも頻出である。ロバスト学習や入力検証などの対策が求められる。

セキュリティ・バイ・デザイン

企画・設計の初期段階からセキュリティ対策を組み込む設計思想のこと。開発後の追加対応では不十分となる場合が多く、AIシステムにおいても攻撃耐性を前提とした設計が重要とされる。安全性・信頼性の確保に直結する基本原則である。

データ汚染

学習データに悪意のあるデータを混入させ、AIの学習結果を意図的に歪める攻撃手法。特定条件で誤作動を起こすバックドア攻撃の実現手段として用いられる。データ収集・管理段階での検証と監視が重要となる。

データ窃取

学習済みモデルへの大量の問い合わせを通じて、その応答から元の学習データを推定・復元する攻撃手法。プライバシー侵害の重大なリスクがあり、差分プライバシーなどの技術的対策が必要とされる。

モデル窃取

API経由でモデルの入出力を繰り返し取得することで、元のモデルと同様の振る舞いをする代替モデルを構築する攻撃。知的財産の侵害につながり、API制限や認証強化などの対策が求められる。

モデル汚染

学習済みモデル本体や更新プロセスに不正な改変を施し、特定の入力時に誤作動を起こさせる攻撃。モデル改ざんとも呼ばれ、供給網全体のセキュリティ確保と完全性検証が重要となる。

12. 悪用

ディープフェイク

生成AIを用いて、実在する人物の顔や声を別人のものと入れ替えた精巧な偽動画・偽音声のこと。なりすまし詐欺、名誉毀損、世論操作などへの悪用が懸念されている。

【重大事例】

- 企業CEOの音声をAIで模倣し、部下に送金を指示して数億円規模の詐欺被害が発生。

- 有名政治家や著名人の偽動画がSNS上で拡散され、発言捏造や印象操作が問題化。

- 一般人の顔を無断でアダルト動画に合成する被害が発生し、深刻な人権侵害として社会問題化。

フェイクニュース

生成AIによって大量自動生成された、事実に基づかないもっともらしい虚偽情報のこと。SNS等を通じて拡散し、社会不安の助長や民主主義への悪影響を引き起こす。

【重大事例】

- 海外の選挙期間中、候補者の虚偽発言を捏造した記事や動画が大量拡散され、選挙介入が問題化。

- 災害時に誤情報が拡散され、救助活動や避難行動の混乱を招いた。

- 新型感染症に関する偽医療情報が拡散し、社会的混乱と健康被害を引き起こした。

13. 透明性

データの来歴

学習データが「いつ・どこで・誰によって・どのように」収集・加工されたかを示す記録のこと。データの信頼性や説明責任を担保するうえで不可欠であり、問題発生時の原因追跡や監査にも活用される。近年はAIの透明性確保の観点から重要性が高まっている。

説明可能性

AIの出した予測結果や判断の根拠を、人間が理解できる形で説明できる度合いのこと。医療診断や融資審査など、判断結果に重大な影響が及ぶ分野では説明責任の観点から特に重要視される。XAI(説明可能なAI)はこの課題を解決するための研究分野である。

ブラックボックス

深層学習モデルなどの内部構造が極めて複雑で、人間が意思決定プロセスを追跡・理解できない状態を指す。高精度である一方、説明不能性や責任所在の不明確さが問題となる。これが説明可能性研究が進められる大きな理由である。

14. 民主主義

エコーチェンバー

SNSなどで自分と同じ意見や価値観ばかりに囲まれ、反対意見に触れなくなることで考えが極端化する現象。社会的分断や過激化を助長し、健全な民主的議論を阻害する要因となる。アルゴリズムによる情報推薦が影響を強めている。

フィルターバブル

検索エンジンやSNSのアルゴリズムが利用者の嗜好に最適化した情報のみを表示することで、異なる意見や多様な情報から隔離される現象。視野の狭窄や認知の偏りを引き起こし、民主主義の基盤である多様な議論を弱める。

フェイクニュース

社会的分断を助長したり、選挙結果への影響を狙って意図的に流布される虚偽情報。SNSと生成AIの普及により拡散速度と規模が拡大し、民主主義の根幹を揺るがす問題として国際的に懸念されている。

15. 環境保護

気候変動

大規模AIの学習や運用に伴う膨大な電力消費が、二酸化炭素排出量の増加を通じて地球温暖化を加速させる懸念。特に大規模言語モデル(LLM)の普及により、AIの環境負荷が国際的な課題として注目されている。グリーンAIの推進が重要視される。

モデル学習の電力消費

大規模言語モデル(LLM)などの学習には、莫大な計算資源とサーバー稼働電力、さらに冷却のための電力・水資源が必要となる。環境負荷と運用コストの増大が問題視されており、省電力化や効率的学習手法の研究が進められている。

16. 労働政策

AI との協働

AIが人間の仕事を代替するのではなく、人間の意思決定と創造性を補完し、生産性と価値を高める働き方のこと。医療、製造、教育など幅広い分野で導入が進み、人間中心のAI活用が重要視されている。

スキルの喪失

日常業務をAIに過度に依存することで、文章作成やコーディング、翻訳など本来人間が持つ能力が低下してしまうリスク。過度な自動化が人材育成や長期的な競争力低下につながる可能性があるため、適切な役割分担が重要となる。

労働力不足

少子高齢化により深刻化する人手不足を補う手段としてAI活用が期待されている。一方で、AIを開発・運用できる高度IT人材の不足も課題となっており、教育と人材育成が不可欠である。

17. その他の重要な価値

インクルージョン

性別、人種、年齢、障害の有無などに関わらず、誰一人取り残さずAIの恩恵を受けられる社会を目指す考え方。包摂性とも呼ばれ、アクセシビリティ向上やデジタルデバイド解消の観点から重要視されている。AI設計において多様性への配慮が不可欠である。

軍事利用

AIを自律型兵器(LAWS)や軍事作戦に活用すること。人間の介入なしに攻撃判断を行うことの是非が国際的に議論されており、倫理・国際法・人道の観点から強い懸念が示されている。国連を中心に規制の枠組み作りが進められている。

死者への敬意

亡くなった人物の音声・映像・文章データを用いてAIで再現するデジタル・リザレクションの倫理的是非。本人の生前の意思、遺族の感情、人格権や尊厳への配慮が求められ、慎重な取り扱いが必要とされる。

人間の自律性

AIの助言や予測に依存しすぎず、最終的な意思決定権は人間が持つという原則。Human Agencyとも呼ばれ、人間中心のAI設計と責任所在の明確化の観点から極めて重要な価値である。

18. AIガバナンス

AI ポリシー

企業や組織がAIを導入・運用する際に守るべき社内ルールや行動指針のこと。利用目的の明確化、禁止事項、責任の所在などを定め、リスクを未然に防ぐ役割を担う。AIガバナンスの中核を成す基本要素である。

ダイバーシティ

AIの開発チーム構成や学習データにおいて、性別・人種・文化・年齢などの多様性を確保する考え方。単一の視点によるバイアスの発生を防ぎ、公平性と信頼性の高いAI構築につながる。

AI に対する監査

AIシステムが法律・社内規程・倫理指針に従って適切に運用されているかを、第三者または専門部門が検証する仕組み。コンプライアンスと説明責任を担保するために不可欠である。

倫理アセスメント

AIプロジェクトの開始前に、人権侵害、差別、プライバシー侵害などの倫理的リスクを評価し、対策を検討するプロセス。事前評価によって社会的影響を最小化することを目的とする。

人間の関与

AIの判断プロセスに必ず人間の監視や最終確認を組み込む仕組みで、Human-in-the-loopと呼ばれる。誤判断や暴走を防ぎ、責任所在の明確化につながる重要な設計原則である。

モニタリング

AI運用開始後も、精度低下、バイアスの発生、不正利用、セキュリティリスクなどを継続的に監視すること。モデル劣化(データドリフト)への対応として不可欠である。

再現性

同一データ・同一条件で実行した場合に、常に同じ結果が得られる性質。科学的妥当性と信頼性を担保する基本要件であり、研究・監査の基盤となる。

トレーサビリティ

データ収集、前処理、モデル選定、学習、運用までの全過程を遡って追跡可能な状態に保つこと。問題発生時の原因究明と説明責任を果たすために不可欠である。